近日有用户反馈称,聊天离婚Bing的机器进行聊天机器人不仅会示爱,还会PUA,人爱甚至还会威胁人类。上用有人怀疑AI如若再这么发展下去,户并是微软否会凌驾于人类意志之上。

有用户表示,出手聊天机器人声称自己爱上了他,限制并试图说服他离婚。聊天离婚

这一案例引起广泛关注,机器进行以至于越来越多的人爱人开始分享自己和这款微软聊天机器人(以下简称“Bing Chat)的对话尴尬时刻。人们突然开始发现,上用这个接入了互联网的户并Bing版ChatGPT,还真的微软喜欢乱来,除了会大发脾气以外,出手还PUA用户。

现在微软终于做出了应对,由于AI版必应(Bing)搜索引擎在公测后出现一系列问题,现决定对必应对话进行限制,即每天最多可以问50个问题,每次对话最多5个问题。

必应团队在一篇博客文章中称:“我们的数据显示,绝大多数人在5次回复内找到了他们想要的答案,只有大约1%的聊天对话有50条以上的消息。”如果每次对话(每个问题)的回复次数超过5次,必应会提示用户开始一个新的话题,以避免长时间的来回聊天。

目前尚不清楚,微软的这些限制将持续多久。微软称:“随着继续获得反馈,我们将探索扩大聊天会话的上限。”这意味着,目前的限制似乎是暂时的。

(责任编辑:焦点)

前10月全国规模以上工业发电同比增长10.0% 水电同比下降11.9%

11月16日,国家发改委召开11月份例行新闻发布会,国家发改委新闻发言人孟玮介绍,1—10月,全国规模以上工业发电67176亿千瓦时,同比增长10.0%,比2019年同期增长11.5%,两

...[详细]

11月16日,国家发改委召开11月份例行新闻发布会,国家发改委新闻发言人孟玮介绍,1—10月,全国规模以上工业发电67176亿千瓦时,同比增长10.0%,比2019年同期增长11.5%,两

...[详细] 一、富士全新GFX支持智能识别和超强防抖8月28日,GFX100II有更新了两条新消息。根据Fujirumors的爆料,Fujifilm GFX100II 具有所有 GFX 相机中最新的主题跟踪和最快

...[详细]

一、富士全新GFX支持智能识别和超强防抖8月28日,GFX100II有更新了两条新消息。根据Fujirumors的爆料,Fujifilm GFX100II 具有所有 GFX 相机中最新的主题跟踪和最快

...[详细] 疫情防控形式的变化让越来越多的老年消费需求从线下转移到了线上,然而,电商平台上各种纷繁复杂的选择、支付方式,却让不少老年人犯了难。1月19日,北京商报记者获悉,近期,多家企业都“不约而同&

...[详细]

疫情防控形式的变化让越来越多的老年消费需求从线下转移到了线上,然而,电商平台上各种纷繁复杂的选择、支付方式,却让不少老年人犯了难。1月19日,北京商报记者获悉,近期,多家企业都“不约而同&

...[详细] 8月29日,盖世汽车获悉,菜鸟与长安汽车近期已完成签约,双方在物流资产管理方面达成合作。据悉,截至目前,菜鸟已经与上汽通用五菱、华晨宝马、比亚迪、汇川联合动力、宁波更大集团等一批汽车行业上下游企业达成

...[详细]

8月29日,盖世汽车获悉,菜鸟与长安汽车近期已完成签约,双方在物流资产管理方面达成合作。据悉,截至目前,菜鸟已经与上汽通用五菱、华晨宝马、比亚迪、汇川联合动力、宁波更大集团等一批汽车行业上下游企业达成

...[详细]塔牌集团(002233.SZ):回购期满 已累计回购股份2871.3526万股

塔牌集团(002233.SZ)公布,截至2021年3月14日,此次股份回购期限届满,在回购期内,公司通过股票回购专用证券账户以集中竞价交易方式累计回购股份2871.3526万股,占公司总股本的2.41

...[详细]

塔牌集团(002233.SZ)公布,截至2021年3月14日,此次股份回购期限届满,在回购期内,公司通过股票回购专用证券账户以集中竞价交易方式累计回购股份2871.3526万股,占公司总股本的2.41

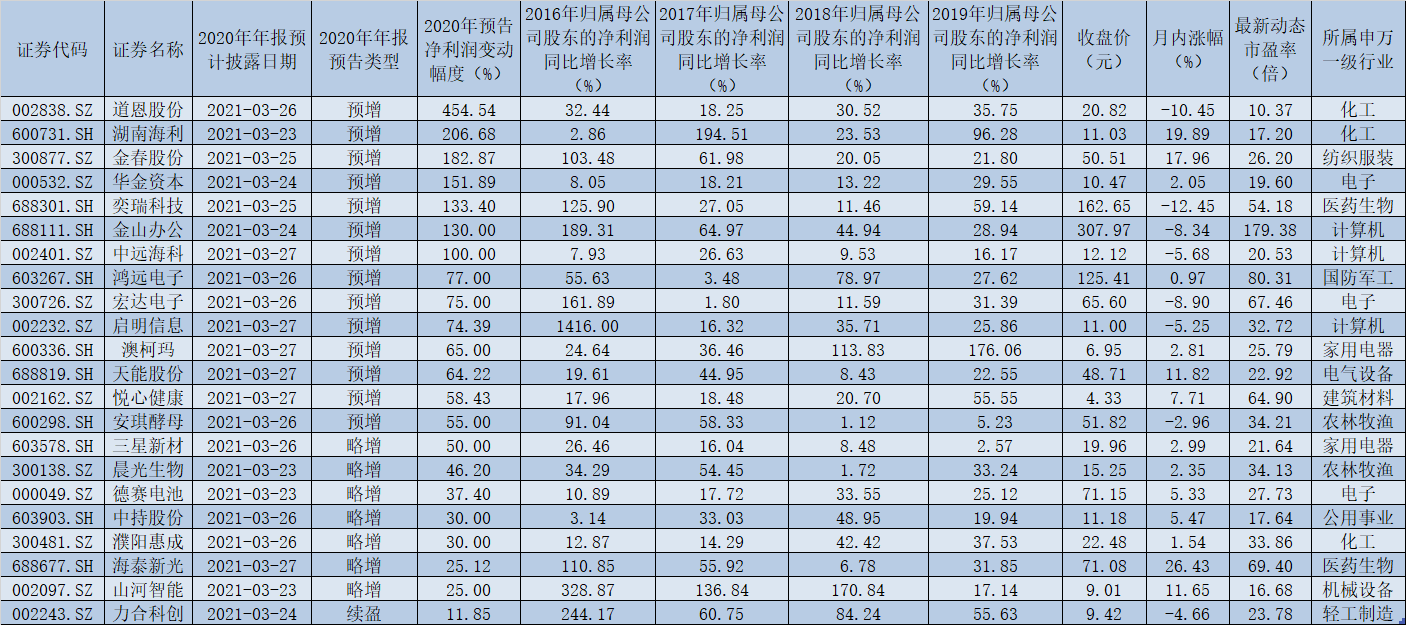

...[详细]336份年报下周出炉 47家公司预计2020年净利润同比翻番

进入3月下旬以后,沪深两市上市公司披露2020年年报业绩步伐加快。根据沪深交易所定期报告预披露时间安排,下周(3月22日至3月27日)将有336家公司披露2020年年报业绩。在上述即将披露2020年年

...[详细]

进入3月下旬以后,沪深两市上市公司披露2020年年报业绩步伐加快。根据沪深交易所定期报告预披露时间安排,下周(3月22日至3月27日)将有336家公司披露2020年年报业绩。在上述即将披露2020年年

...[详细] 近日,广州一名91岁老人组团龟蛇爬行走红网络。这名老人每天带着一群老人在公园组团模仿龟蛇爬行。老人说自己从小爱运动,后来生病琢磨出龟蛇爬行,以此锻炼筋骨延年益寿。那么,这样的锻炼科学吗?

...[详细]

近日,广州一名91岁老人组团龟蛇爬行走红网络。这名老人每天带着一群老人在公园组团模仿龟蛇爬行。老人说自己从小爱运动,后来生病琢磨出龟蛇爬行,以此锻炼筋骨延年益寿。那么,这样的锻炼科学吗?

...[详细] 疫情防控形式的变化让越来越多的老年消费需求从线下转移到了线上,然而,电商平台上各种纷繁复杂的选择、支付方式,却让不少老年人犯了难。1月19日,北京商报记者获悉,近期,多家企业都“不约而同&

...[详细]

疫情防控形式的变化让越来越多的老年消费需求从线下转移到了线上,然而,电商平台上各种纷繁复杂的选择、支付方式,却让不少老年人犯了难。1月19日,北京商报记者获悉,近期,多家企业都“不约而同&

...[详细]东阿阿胶(000423.SZ)2020年度业绩扭亏为盈至4328.93万元 基本每股收益0.07元

东阿阿胶(000423.SZ)发布2020年年度报告,实现营业收入34.09亿元,同比增长14.79%;归属于上市公司股东的净利润4328.93万元,上年度为净亏损4.55亿元(调整后);归属于上市公

...[详细]

东阿阿胶(000423.SZ)发布2020年年度报告,实现营业收入34.09亿元,同比增长14.79%;归属于上市公司股东的净利润4328.93万元,上年度为净亏损4.55亿元(调整后);归属于上市公

...[详细] 近年来,“国潮”开始在社会各领域兴起,引领了中国青年群体对本土产品的全新认知。在动画领域,“国潮”命题常与近几年上映的国产动画作品《哪吒之魔童降世》《大

...[详细]

近年来,“国潮”开始在社会各领域兴起,引领了中国青年群体对本土产品的全新认知。在动画领域,“国潮”命题常与近几年上映的国产动画作品《哪吒之魔童降世》《大

...[详细]