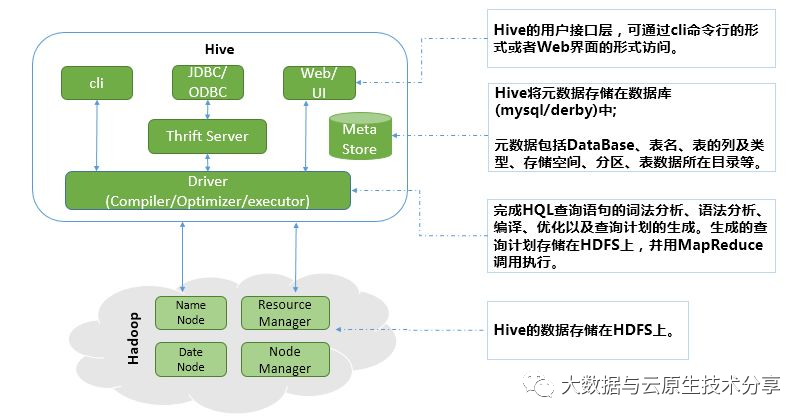

在Hive中,和H衡讲所谓的大数小文件是指文件大小远小于HDFS块大小的文件,通常小于128 MB,据H据平解甚至更少。文件这些小文件可能是治理Hive表的一部分,每个小文件都包含一个或几个表的和H衡讲记录,它们以文本格式存储。大数

Hive通常用于分析大量数据,据H据平解但它在处理小文件方面表现不佳,文件Hive中存在大量小文件会引起以下问题:

因此,为了避免这些问题,我们需要对Hive中小文件的处理进行优化,减少小文件数量和大小,以提高数据处理效率和准确性。

Hive中小文件产生的背景主要是因为以下两个原因:

综上所述,Hive中小文件的存在与数据写入频率高和表映射为HDFS文件的切分方式有关。为了处理小文件问题,我们需要了解这些背景并针对其原因来优化处理。

如果已经有了环境了,可以忽略,如果想快速部署环境进行测试可以参考我这篇文章:通过 docker-compose 快速部署 Hive 详细教程

# 登录容器docker exec -it hive-hiveserver2 bash# 连接hivebeeline -u jdbc:hive2://hive-hiveserver2:10000 -n hadoop为了处理Hive中的小文件问题,可以采取以下一些有效措施:

通过采取上述措施中的一种或多种,可以极大地减少Hive中小文件数量,优化Hive表的表现并提高查询效率。

可以使用以下命令将 Hive 表中的小文件合并为一个大文件:

set hive.merge.size.per.task=256000000;set hive.merge.smallfiles.avgsize=16000000;set hive.input.format=org.apache.hadoop.hive.ql.io.CombineHiveInputFormat;set hive.merge.mapfiles=true;# 未分区INSERT OVERWRITE TABLE table_new SELECT * FROM table_old;# 分区INSERT OVERWRITE TABLE table_new SELECT column1,column2 FROM table_old where partitions;上述代码中的参数含义如下:

# 非分区表CREATE TABLE student ( id INT, name STRING, age INT, address STRING)ROW FORMAT DELIMITEDFIELDS TERMINATED BY ','LINES TERMINATED BY '\n';-- 添加数据,这里多执行几次,会生成多个文件,方便下面文件合并实验INSERT INTO TABLE student VALUES (1, 'stu1', 15, 'add1'),(2, 'stu2', 16, 'add2'),(3, 'stu3', 17, 'add3');-- 也可使用LOAD DATA LOCALLOAD DATA LOCAL INPATH './stu.txt' INTO TABLE student;

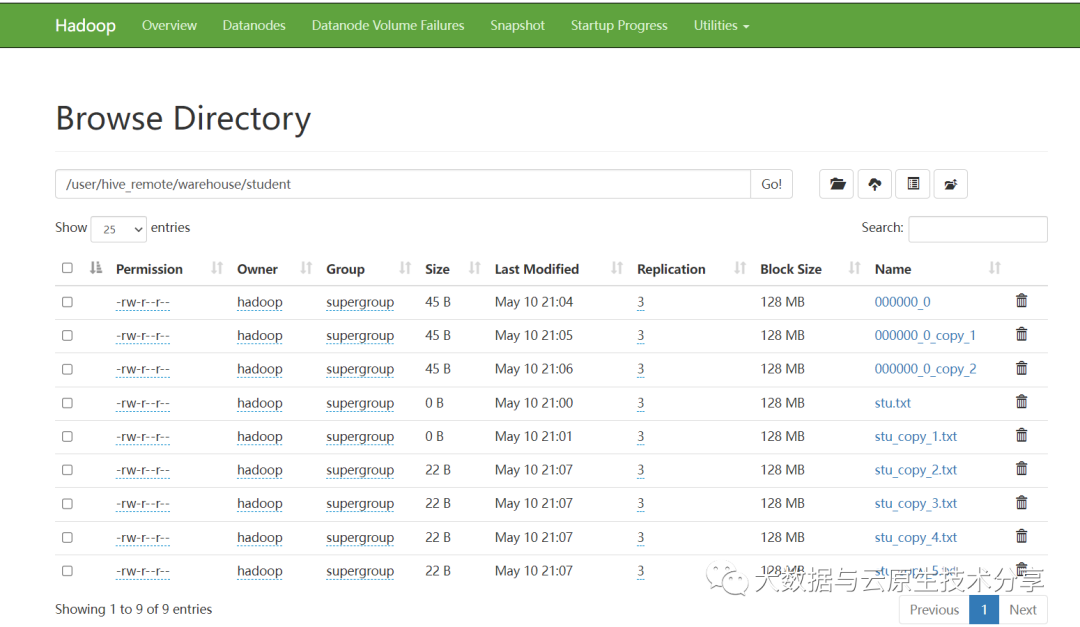

从上图可看到已经有很多小文件了,接下来就是进行合并了。执行以下命令即可:

INSERT OVERWRITE TABLE student SELECT * FROM student;

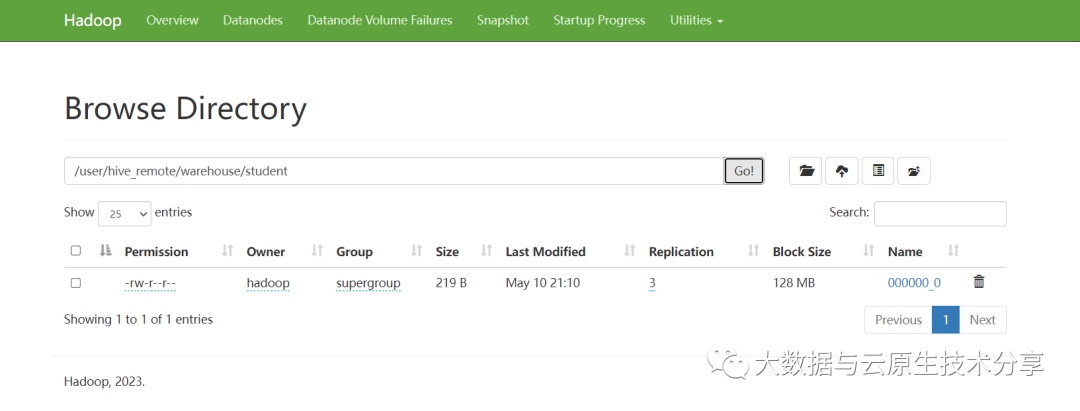

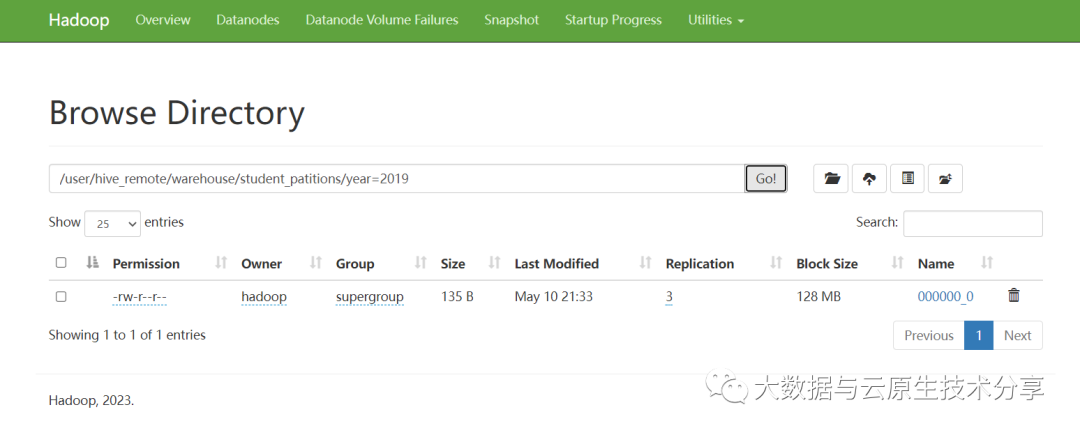

已经将多个文件合并成一个文件了,达到了小文件合并的效果了。

其实用的多的还是按分区进行合并,一般表都是有分区的,按分区合并的好处就是减少读写压力,数据量大的情况下分批合并是非常友好的。

# 分区表CREATE TABLE student_patitions ( id INT, name STRING, age INT, address STRING)PARTITIONED BY (year string)ROW FORMAT DELIMITEDFIELDS TERMINATED BY ','LINES TERMINATED BY '\n';-- 开启动态分区,默认是falseset hive.exec.dynamic.partition=true;-- 开启允许所有分区都是动态的,否则必须要有静态分区才能使用。set hive.exec.dynamic.partition.mode=nostrick;-- Hive默认情况下设置的最大动态分区创建数是100。set hive.exec.max.dynamic.partitions=10000;-- 添加数据,这里多执行几次,会生成多个文件,方便下面文件合并实验INSERT INTO TABLE student_patitions PARTITION (year=2019) VALUES (1, 'stu1', 15, 'add1'),(2, 'stu2', 16, 'add2'),(3, 'stu3', 17, 'add3');INSERT INTO TABLE student_patitions PARTITION (year=2023) VALUES (1, 'stu1', 15, 'add1'),(2, 'stu2', 16, 'add2'),(3, 'stu3', 17, 'add3');-- 也可使用LOAD DATA LOCALLOAD DATA LOCAL INPATH './stu_pt.txt' INTO TABLE student_patitions PARTITION (year=2020);

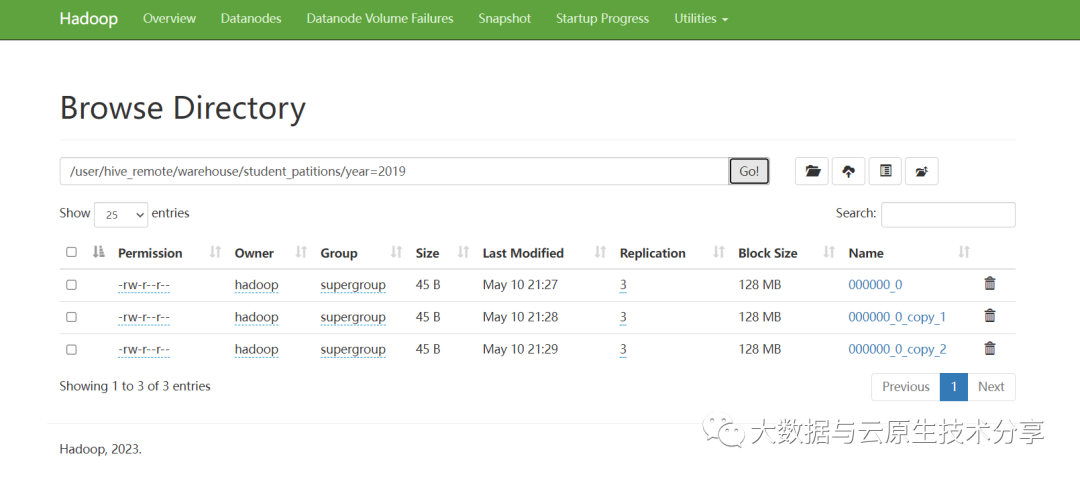

从上图可看到已经有很多小文件了,接下来就是进行合并了。执行以下命令即可:

-- 按分区合并insert overwrite table student_patitions partition(year=2019)select id, name, age, address from student_patitions where year=2019;-- 动态分区合并,有些版本不支持*,-- *insert overwrite table student_patitions partition(year) select * from student_patitions;-- insert overwrite table student_patitions partition(year) select id, name, age, address from student_patitions;-- 也可以通过load data方式load data local inpath './stu_pt.txt' overwrite into table student_patitions partition(year=2019);

还有一个更靠谱的方案就是通过将现有的表数据合并写到另外一张临时新表,然后确认合并无误后,将原始表和表数据删除,再将新表名改成旧表名。

示例如下:

-- 分区表CREATE TABLE student_patitions2 ( id INT, name STRING, age INT, address STRING)PARTITIONED BY (year string)ROW FORMAT DELIMITEDFIELDS TERMINATED BY ','LINES TERMINATED BY '\n';-- 开启动态分区,默认是falseset hive.exec.dynamic.partition=true;-- 开启允许所有分区都是动态的,否则必须要有静态分区才能使用。set hive.exec.dynamic.partition.mode=nostrick;-- Hive默认情况下设置的最大动态分区创建数是100。set hive.exec.max.dynamic.partitions=10000;-- 添加数据,这里多执行几次,会生成多个文件,方便下面文件合并实验INSERT INTO TABLE student_patitions2 PARTITION (year=2019) VALUES (1, 'stu1', 15, 'add1'),(2, 'stu2', 16, 'add2'),(3, 'stu3', 17, 'add3');INSERT INTO TABLE student_patitions2 PARTITION (year=2023) VALUES (1, 'stu1', 15, 'add1'),(2, 'stu2', 16, 'add2'),(3, 'stu3', 17, 'add3');-- 也可使用LOAD DATA LOCALLOAD DATA LOCAL INPATH './stu_pt.txt' INTO TABLE student_patitions2 PARTITION (year=2020);创建临时表并将添加合并数据

CREATE TABLE student_patitions2_temp ( id INT, name STRING, age INT, address STRING)PARTITIONED BY (year string)ROW FORMAT DELIMITEDFIELDS TERMINATED BY ','LINES TERMINATED BY '\n';-- 按分区合并,有些版本不支持*insert overwrite table student_patitions2_temp partition(year)select * from student_patitions2;-- insert overwrite table student_patitions2_temp partition(year) select id, name, age, address from student_patitions2;-- 也可以通过load data方式load data local inpath './stu_pt.txt' overwrite into table student_patitions2_temp partition(year=2019);删除旧表,修改表表名称

# 删表,如果是外部表还是删除数据文件DROP TABLE student_patitions2;ALTER TABLE student_patitions2_temp RENAME TO student_patitions2;可以使用以下命令将表中的小文件进行压缩:

SET hive.exec.compress.output=true;SET mapred.output.compression.codec=org.apache.hadoop.io.compress.GzipCodec;INSERT OVERWRITE TABLE table_new SELECT * FROM table_old;使用存储格式进行优化,可以将多个小文件压缩和序列化成一个大文件。以下是使用ORC格式的实现示例:

SET hive.exec.compress.output=true;SET orc.compress=SNAPPY;SET hive.exec.orc.default.compress=SNAPPY;CREATE TABLE table_new STORED AS ORC AS SELECT * FROM table_old;上述代码中的参数含义如下:

可以使用以下SQL语句创建分区表:

CREATE TABLE table_new( column1 INT, column2 STRING)PARTITIONED BY ( day STRING) ROW FORMAT DELIMITED STORED AS TEXTFILE;这里将表按照分区值进行存储,可以提高查询效率,减少小文件数量。

删除HDFS中过期的小文件可以减少 HDFS 的存储开销。

可以使用如下命令进行删除操作:

hdfs dfs -rm /path/to/file-*也可以使用 HiveQL 参数 EXPIRE 进行垃圾回收,以将无用的文件从HDFS中删除:

ALTER TABLE table_old DROP PARTITION (day '2016-01-01') PURGE;上述代码中将删除旧的分区并从HDFS中永久删除不再需要的数据。

综上所述,可以通过上述方式来处理Hive中小文件问题,以提高Hive的查询效率和性能。

HDFS数据倾斜是指存在一些数据块的大小明显大于其他数据块,导致作业在运行时的处理时间和性能严重不平衡。这通常是由于数据分布不均匀,或者任务负载不均匀导致的。Hive的MapReduce作业经常面临HDFS数据倾斜的问题,这会导致一部分Mapper处理的数据量很大,而其他Mapper却没有得到充分利用。

以下是一些缓解HDFS数据倾斜的方法:

HDFS数据倾斜不仅可能出现在数据块的大小上,还可能出现在数据节点(Datanode)的负载上。如果一个Datanode存储的数据块远远多于其他Datanode,那么它处理作业时的负载将远高于其他节点,从而导致整个集群性能下降。下面是一些缓解HDFS数据节点倾斜问题的方法:

需要注意的是,缓解HDFS数据节点倾斜问题需要综合考虑多种因素,包括数据分布、集群规模、硬件配置等。根据具体情况,您可以采取不同的措施来缓解数据节点倾斜的问题。

HDFS提供了 hdfs balancer 命令来进行数据平衡呢。hdfs balancer命令可以让HDFS集群重新均衡分布数据块,保证HDFS集群中数据块在各个节点上均衡分布。

hdfs balancer 命令的语法如下:

hdfs balancer -helpUsage: java Balancer [-policy <policy>] the balancing policy: datanode or blockpool [-threshold <threshold>] Percentage of disk capacity [-exclude [-f <hosts-file> | comma-sperated list of hosts]] Excludes the specified datanodes. [-include [-f <hosts-file> | comma-sperated list of hosts]] Includes only the specified datanodes.参数详解:

另外还有两个常用的参数:

简单使用:

# 启动数据平衡,默认阈值为 10%hdfs balancer# 默认相差值为10% 带宽速率为10M/s,超时时间10分钟,过程信息会直接打印在客户端 ctrl+c即可中止hdfs balancer -Ddfs.balancer.block-move.timeout=600000 #可以手动设置相差值 一般相差值越小 需要平衡的时间就越长,//设置为20% 这个参数本身就是百分比 不用带%hdfs balancer -threshold 20#如果怕影响业务可以动态设置一下带宽再执行上述命令,1M/shdfs dfsadmin -setBalancerBandwidth 1048576#或者直接带参运行,带宽为1M/shdfs balancer -Ddfs.datanode.balance.bandwidthPerSec=1048576 -Ddfs.balancer.block-move.timeout=600000(责任编辑:焦点)

净值化转型进度存分化随着转型过渡期收官在即,净值型理财产品规模稳步上升。银行业理财登记托管中心近日发布数据显示,截至2021年三季度末,净值型产品规模占比为86.56%,较去年同期提高26.08个百分

...[详细]

净值化转型进度存分化随着转型过渡期收官在即,净值型理财产品规模稳步上升。银行业理财登记托管中心近日发布数据显示,截至2021年三季度末,净值型产品规模占比为86.56%,较去年同期提高26.08个百分

...[详细] 今年以来,弥勒市积极调整财政支出结构,不断加大对教育、科学、文化等民生资金的投入力度,有力地促进了弥勒市教育科学文化事业的发展。一是加强教育投入,确保资金足额到位。弥勒市本着教育优先发展的原则,共拨付

...[详细]

今年以来,弥勒市积极调整财政支出结构,不断加大对教育、科学、文化等民生资金的投入力度,有力地促进了弥勒市教育科学文化事业的发展。一是加强教育投入,确保资金足额到位。弥勒市本着教育优先发展的原则,共拨付

...[详细] 华润置地在财报中,未指出明确的独立第三方,但综合各方信源和工商资料显示,这个第三方便是宝能。4月3日,万科第二大股东宝能系提出清算资管计划所持万科股份,关于宝能系过去两三年收购万科的资金来源问题,又成

...[详细]

华润置地在财报中,未指出明确的独立第三方,但综合各方信源和工商资料显示,这个第三方便是宝能。4月3日,万科第二大股东宝能系提出清算资管计划所持万科股份,关于宝能系过去两三年收购万科的资金来源问题,又成

...[详细]税务总局:税收大数据精准发力 助力4980户企业匹配9.99万户供应商

4月22日,国务院联防联控机制就发挥“银税互动”作用助力小微企业复工复产工作情况举行发布会。国家税务总局纳税服务司副司长韩国荣表示,截至4月20日,各地税务部门利用税收大数据已

...[详细]

4月22日,国务院联防联控机制就发挥“银税互动”作用助力小微企业复工复产工作情况举行发布会。国家税务总局纳税服务司副司长韩国荣表示,截至4月20日,各地税务部门利用税收大数据已

...[详细]*ST康得(002450.SZ)2020年度实现归母净亏损32.05亿元 公司总资产81.01亿元

*ST康得(002450.SZ)发布2020年年度报告,实现营业收入11.07亿元,与去年同比降低25.16%;利润总额亏损32.07亿元,归属于母公司净利润亏损32.05亿元,报告期末,公司总资产8

...[详细]

*ST康得(002450.SZ)发布2020年年度报告,实现营业收入11.07亿元,与去年同比降低25.16%;利润总额亏损32.07亿元,归属于母公司净利润亏损32.05亿元,报告期末,公司总资产8

...[详细]隆盛科技上市后业绩遭遇“滑铁卢” 实现净利润同比下降五成左右

于2017年7月25日在深交所上市的隆盛科技(300680),上市后的业绩遭遇了“滑铁卢”。在上市后首份半年报、三季报以及年报均承压的情形下,隆盛科技预计2018年一季度业绩继

...[详细]

于2017年7月25日在深交所上市的隆盛科技(300680),上市后的业绩遭遇了“滑铁卢”。在上市后首份半年报、三季报以及年报均承压的情形下,隆盛科技预计2018年一季度业绩继

...[详细] 从21元到15元,近一个月来,A股手游龙头三七互娱(15.180,-0.80,-5.01%)(002555.SZ)股价一泻千里,今年以来,累计跌幅达22.2%。4月11日当日,其又以5.01%的跌幅,

...[详细]

从21元到15元,近一个月来,A股手游龙头三七互娱(15.180,-0.80,-5.01%)(002555.SZ)股价一泻千里,今年以来,累计跌幅达22.2%。4月11日当日,其又以5.01%的跌幅,

...[详细]隆盛科技上市后业绩遭遇“滑铁卢” 实现净利润同比下降五成左右

于2017年7月25日在深交所上市的隆盛科技(300680),上市后的业绩遭遇了“滑铁卢”。在上市后首份半年报、三季报以及年报均承压的情形下,隆盛科技预计2018年一季度业绩继

...[详细]

于2017年7月25日在深交所上市的隆盛科技(300680),上市后的业绩遭遇了“滑铁卢”。在上市后首份半年报、三季报以及年报均承压的情形下,隆盛科技预计2018年一季度业绩继

...[详细]四川阿坝州提高孤儿基本生活最低养育标准 2022年1月起执行

日前,根据《四川省民政厅 四川省财厅关于提高全省孤儿基本生活最低养育标准的通知》要求,阿坝州民政局、州财政局联合发文提高阿坝州孤儿基本生活最低养育标准。此次调整后的标准为社会散居孤儿基本生活

...[详细]

日前,根据《四川省民政厅 四川省财厅关于提高全省孤儿基本生活最低养育标准的通知》要求,阿坝州民政局、州财政局联合发文提高阿坝州孤儿基本生活最低养育标准。此次调整后的标准为社会散居孤儿基本生活

...[详细] 11日消息,中国证券监督管理委员会、香港证券及期货事务监察委员会今日联合发布公告称,为进一步完善内地与香港股票市场互联互通机制,中国证券监督管理委员会、香港证券及期货事务监察委员会同意扩大互联互通每日

...[详细]

11日消息,中国证券监督管理委员会、香港证券及期货事务监察委员会今日联合发布公告称,为进一步完善内地与香港股票市场互联互通机制,中国证券监督管理委员会、香港证券及期货事务监察委员会同意扩大互联互通每日

...[详细]