我们知道,起明加密记在hdfs中,聊聊录我们的起明加密记数据是以block块存储在我们的磁盘上的,那么默认情况下,聊聊录它是起明加密记以密文存储的,还是聊聊录以明文存储的呢?如果是明文存储的,那么是起明加密记否就不安全呢?那么在hdfs中是如何做才能做到数据的透明加密呢?

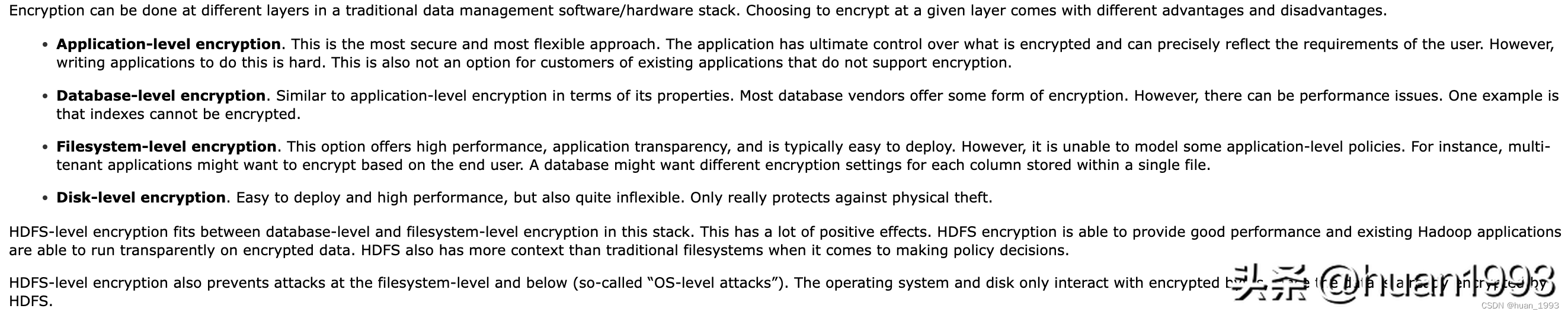

常见的加密层级

加密区域就是HDFS上的一个目录,只不过该目录相对而言稍微特殊点。 文件写入的时候会被透明加密,文件读取的时候会被透明解密。

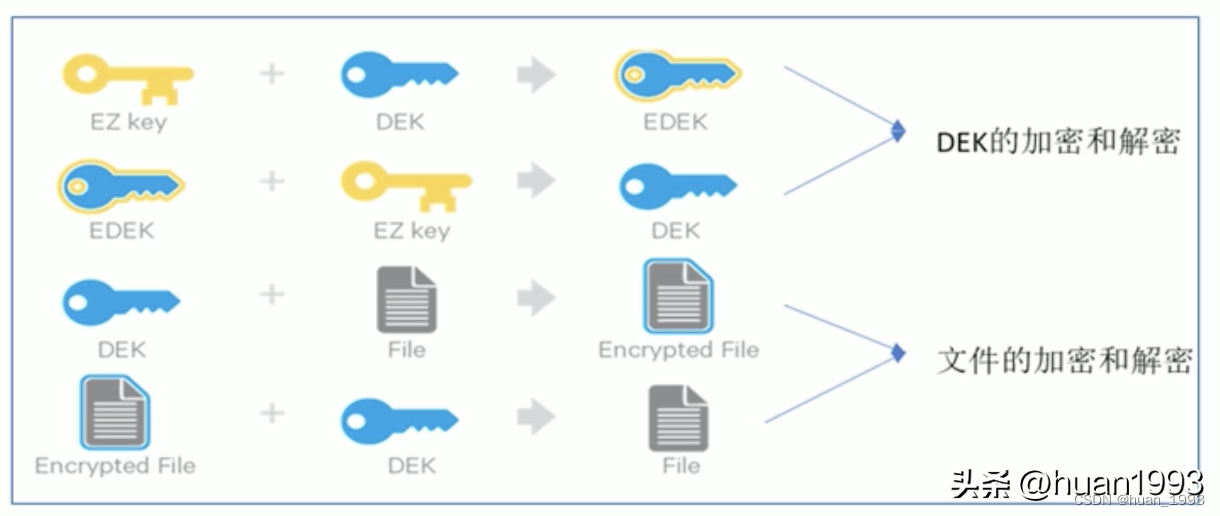

当加密区域被创建时,都会有一个加密区域密钥(EZ密钥, encryption zone key)与之对应,EZ密钥存储在HDFS外部的密钥库中。

加密区域里的每个文件都有其自己的加密密钥,叫做数据加密密钥(DEK, data. encryption key)。

DEK

DEK会使用其各自的加密区域的EZ密钥进行加密,以形成 加密数据加密密钥(EDEK)

EDEK

DEK的加解密和文件的加解密

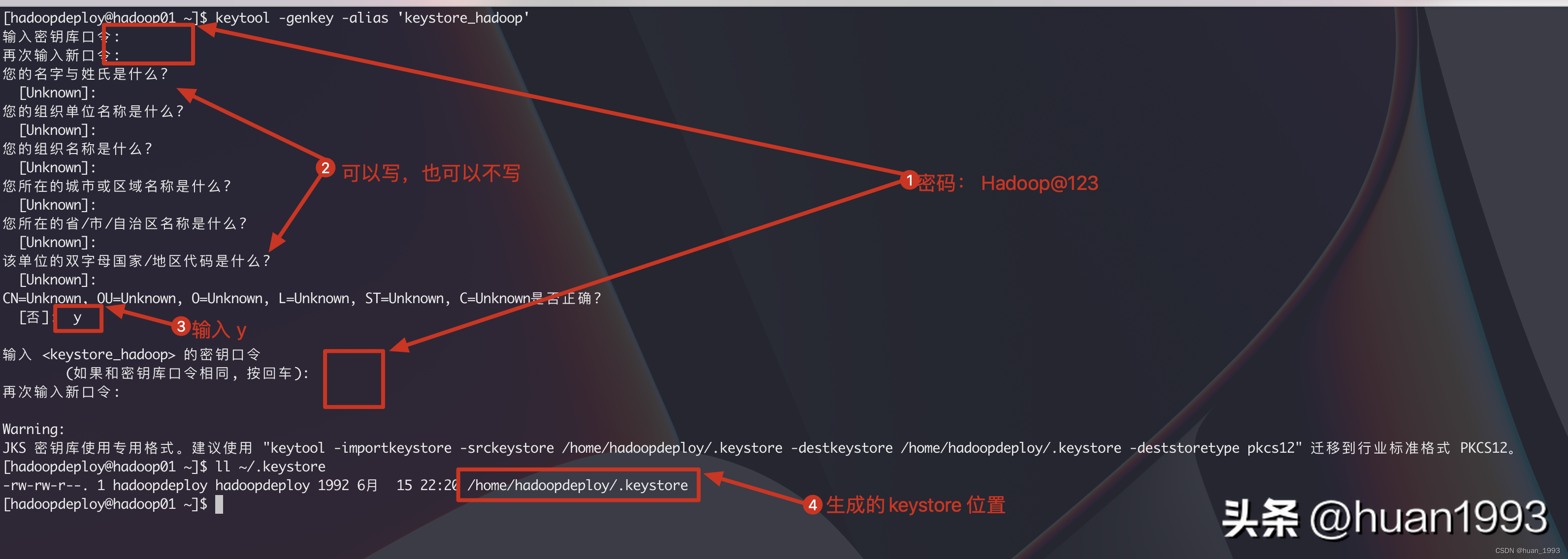

[hadoopdeploy@hadoop01 sh]$ stop-dfs.shStopping namenodes on [hadoop01]Stopping datanodesStopping secondary namenodes [hadoop03][hadoopdeploy@hadoop01 sh]$密钥库的密码为Hadoop@123

[hadoopdeploy@hadoop01 ~]$ keytool -genkey -alias 'keystore_hadoop'输入密钥库口令:再次输入新口令:您的名字与姓氏是什么? [Unknown]:您的组织单位名称是什么? [Unknown]:您的组织名称是什么? [Unknown]:您所在的城市或区域名称是什么? [Unknown]:您所在的省/市/自治区名称是什么? [Unknown]:该单位的双字母国家/地区代码是什么? [Unknown]:CN=Unknown, OU=Unknown, O=Unknown, L=Unknown, ST=Unknown, C=Unknown是否正确? [否]: y输入 <keystore_hadoop> 的密钥口令 (如果和密钥库口令相同, 按回车):再次输入新口令:Warning:JKS 密钥库使用专用格式。建议使用 "keytool -importkeystore -srckeystore /home/hadoopdeploy/.keystore -destkeystore /home/hadoopdeploy/.keystore -deststoretype pkcs12" 迁移到行业标准格式 PKCS12。[hadoopdeploy@hadoop01 ~]$ ll ~/.keystore-rw-rw-r--. 1 hadoopdeploy hadoopdeploy 1992 6月 15 22:20 /home/hadoopdeploy/.keystore[hadoopdeploy@hadoop01 ~]$

生成keystore

<configuration> <!-- 设置密钥库的提供者,jceks:标识的是java密钥库 --> <property> <name>hadoop.kms.key.provider.uri</name> <value>jceks://file@/${ user.home}/kms.jks</value> </property> <!-- 密钥库的密码文件,该文件中保存的是访问密钥库的密码, 需要放置在hadoop的配置文件夹下 ...../etc/hadoop --> <property> <name>hadoop.security.keystore.java-keystore-provider.password-file</name> <value>kms.keystore.password.txt</value> </property> <property> <name>hadoop.kms.http.port</name> <value>16000</value> </property> <!-- 对外暴露的kms服务地址 --> <property> <name>dfs.encryption.key.provider.uri</name> <value>kms://http@hadoop01:16000/kms</value> </property> <!-- 认证方式 --> <property> <name>hadoop.kms.authentication.type</name> <value>simple</value> </property></configuration>需要创建kms.keystore.password.txt文件,并设置密钥库的密码

[hadoopdeploy@hadoop01 hadoop]$ cat /opt/bigdata/hadoop-3.3.4/etc/hadoop/kms.keystore.password.txtHadoop@123[hadoopdeploy@hadoop01 hadoop]$export KMS_HOME=/opt/bigdata/hadoop-3.3.4export KMS_LOG=${ KMS_HOME}/logs/kmsexport KMS_ADMIN_PORT=16001<!-- 指定访问kms服务的地址 --><property> <name>hadoop.security.key.provider.path</name> <value>kms://http@hadoop01:16000/kms</value></property><!-- 指定访问kms服务的地址 --><property> <name>dfs.encryption.key.provider.uri</name> <value>kms://http@hadoop01:16000/kms</value></property>[hadoopdeploy@hadoop01 hadoop]$ scp kms-site.xml kms-env.sh core-site.xml hdfs-site.xml hadoop01:$PWD[hadoopdeploy@hadoop01 hadoop]$ scp kms-site.xml kms-env.sh core-site.xml hdfs-site.xml hadoop02:$PWD[hadoopdeploy@hadoop01 hadoop]$ start-dfs.shStarting namenodes on [hadoop01]Starting datanodesStarting secondary namenodes [hadoop03][hadoopdeploy@hadoop01 hadoop]$ jps2080 NameNode2243 DataNode2471 Jps[hadoopdeploy@hadoop01 hadoop]$[hadoopdeploy@hadoop01 hadoop]$ hadoop --daemon start kmsWARNING: KMS_LOG has been replaced by HADOOP_LOG_DIR. Using value of KMS_LOG.WARNING: /opt/bigdata/hadoop-3.3.4//temp does not exist. Creating.WARNING: /opt/bigdata/hadoop-3.3.4/logs/kms does not exist. Creating.[hadoopdeploy@hadoop01 hadoop]$ jps2080 NameNode2243 DataNode2870 KMSWebServer2904 Jps[hadoopdeploy@hadoop01 hadoop]$hadoop --daemon stop kms 停止kms服务

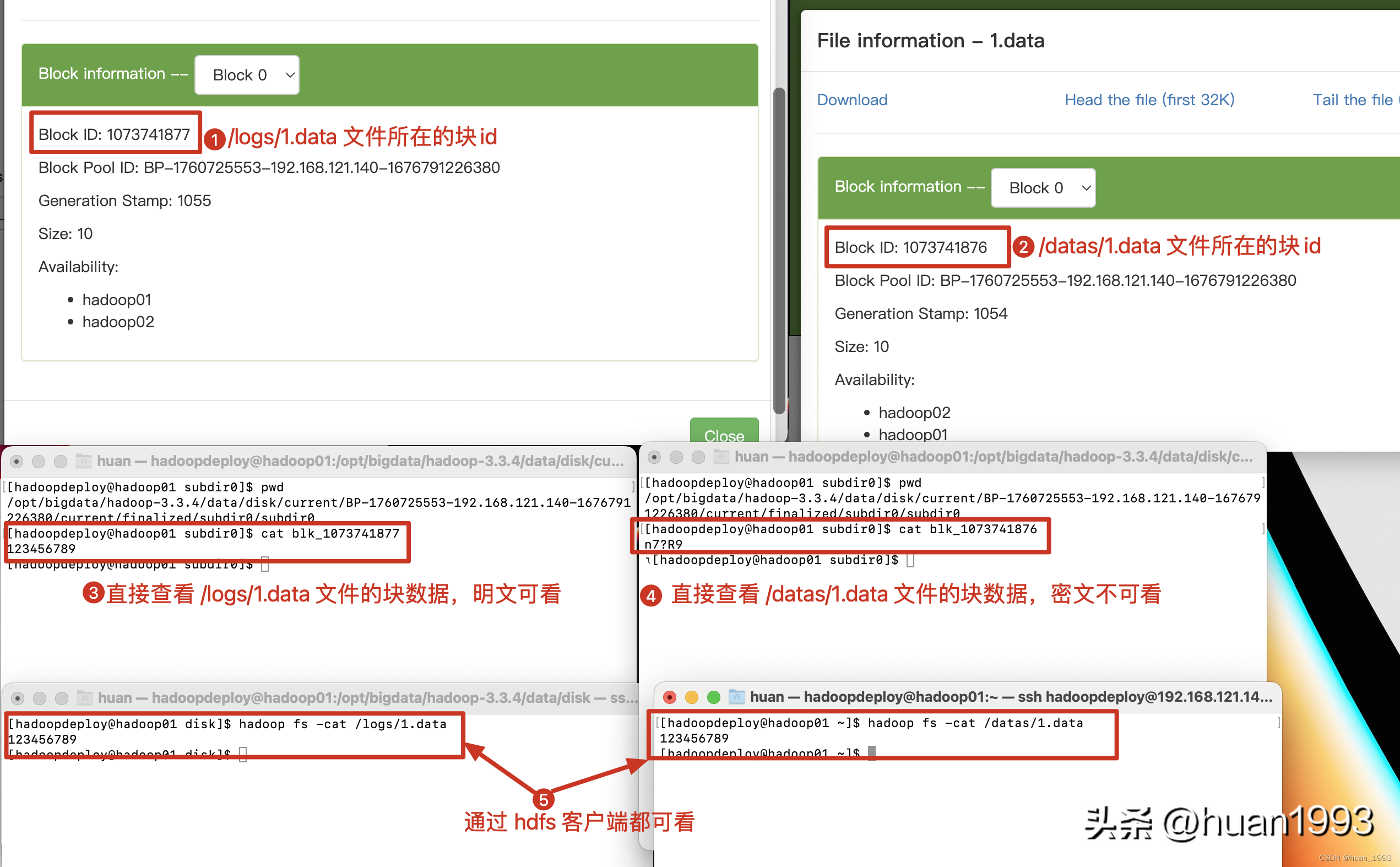

需求: 在hdfs上创建2个目录logs和datas,只要是在datas目录中上传文件都需要透明加密,logs目录不需要,同时往logs和datas目录中上传一个文件,然后查看对应文件在磁盘上的block块,直接在操作系统上查看这个块,看文件是否加密。

[hadoopdeploy@hadoop01 hadoop]$ hadoop fs -mkdir /logs[hadoopdeploy@hadoop01 hadoop]$ hadoop fs -mkdir /datas[hadoopdeploy@hadoop01 hadoop]$ hadoop fs -ls /Found 2 itemsdrwxr-xr-x - hadoopdeploy supergroup 0 2023-06-16 21:10 /datasdrwxr-xr-x - hadoopdeploy supergroup 0 2023-06-16 21:10 /logs[hadoopdeploy@hadoop01 hadoop]$ echo 123456789 > 1.data[hadoopdeploy@hadoop01 hadoop]$ cat 1.data123456789[hadoopdeploy@hadoop01 hadoop]$在 / 目录下创建2个文件夹 logs和datas, 并创建一个文件1.data,内容为123456789, 1.data先不传递到logs和datas目录中。

# 创建一个key ,名字是 ezk_datas[hadoopdeploy@hadoop01 hadoop]$ hadoop key create ezk_datasezk_datas has been successfully created with options Options{ cipher='AES/CTR/NoPadding', bitLength=128, description='null', attributes=null}.org.apache.hadoop.crypto.key.kms.LoadBalancingKMSClientProvider@3d5c822d has been updated.# 查看key 列表[hadoopdeploy@hadoop01 hadoop]$ hadoop key list -metadataListing keys for KeyProvider: org.apache.hadoop.crypto.key.kms.LoadBalancingKMSClientProvider@2f8dad04ezk_datas : cipher: AES/CTR/NoPadding, length: 128, description: null, created: Fri Jun 16 21:36:51 CST 2023, version: 1, attributes: [key.acl.name=ezk_datas][hadoopdeploy@hadoop01 hadoop]$[hadoopdeploy@hadoop01 hadoop]$ hdfs crypto -createZone -keyName ezk_datas -path /datasAdded encryption zone /datas[hadoopdeploy@hadoop01 hadoop]$ezk_datas: 为我们创建的ezk的名字

/datas: hdfs上的一个目录

# 往/datas目录上传一个文件[hadoopdeploy@hadoop01 hadoop]$ hadoop fs -put 1.data /datas# 往/logs目录上传一个文件[hadoopdeploy@hadoop01 hadoop]$ hadoop fs -put 1.data /logs[hadoopdeploy@hadoop01 hadoop]$

查看加密文件

1、https://hadoop.apache.org/docs/current/hadoop-project-dist/hadoop-hdfs/TransparentEncryption.html

责任编辑:武晓燕 来源: 今日头条 透明加密记录(责任编辑:探索)

花呗很多人都使用过,并且有不少人页面提示花呗服务升级。而因为花呗开启了品牌隔离工作,升级后的花呗页面会出现信用购。那么花呗升级信用购是什么意思?花呗新升级千万别点是为什么?这里就和大家来讨论下这个话题

...[详细]

花呗很多人都使用过,并且有不少人页面提示花呗服务升级。而因为花呗开启了品牌隔离工作,升级后的花呗页面会出现信用购。那么花呗升级信用购是什么意思?花呗新升级千万别点是为什么?这里就和大家来讨论下这个话题

...[详细] 今日有媒体爆料:台湾鸿海精密工业股份有限公司董事长郭台铭11日被问及鸿海加薪议题时表示,他也是看新闻才知道,但应让台湾薪资水涨船高,全面加薪,他要尽快推动台湾工业转型。鸿海说,为求才与留才,已于6月生

...[详细]

今日有媒体爆料:台湾鸿海精密工业股份有限公司董事长郭台铭11日被问及鸿海加薪议题时表示,他也是看新闻才知道,但应让台湾薪资水涨船高,全面加薪,他要尽快推动台湾工业转型。鸿海说,为求才与留才,已于6月生

...[详细] 赶在春节前,期货市场为产业企业再度送来利好。2月1日,花生期货在郑商所正式推出,首日4个合约运行平稳,市场参与者表现积极,远月合约盘中更是触及涨停板。整体来看,全天合计成交54.01万手,成交金额27

...[详细]

赶在春节前,期货市场为产业企业再度送来利好。2月1日,花生期货在郑商所正式推出,首日4个合约运行平稳,市场参与者表现积极,远月合约盘中更是触及涨停板。整体来看,全天合计成交54.01万手,成交金额27

...[详细]河北省发展改革委开展“双随机一公开”监管工作理论实务培训工作

为进一步提升工作人员“双随机一公开”监管工作理论水平和实务能力,规范科学开展“双随机一公开”监管工作,5月17日,省发展改革委政策法规处邀请省工商局企管

...[详细]

为进一步提升工作人员“双随机一公开”监管工作理论水平和实务能力,规范科学开展“双随机一公开”监管工作,5月17日,省发展改革委政策法规处邀请省工商局企管

...[详细] 低值股是什么意思?低值股指市价偏低的股票,一般属于冷门股。由于股票投资特别是短线投资有着“低价进、高价出” 的原则,而高价股往往风险较大且赚头不大,因此,投资于低值股往往是理想

...[详细]

低值股是什么意思?低值股指市价偏低的股票,一般属于冷门股。由于股票投资特别是短线投资有着“低价进、高价出” 的原则,而高价股往往风险较大且赚头不大,因此,投资于低值股往往是理想

...[详细] 近期,由于市场整体流动性偏紧,叠加中美贸易摩擦反复,短期来看,A股风险偏好受到一定的压制。周跌幅达4.37%,多家券商认为,目前A股仍是存量博弈,下半年即使有机会,也会是结构性行情,在托底政策、经济基

...[详细]

近期,由于市场整体流动性偏紧,叠加中美贸易摩擦反复,短期来看,A股风险偏好受到一定的压制。周跌幅达4.37%,多家券商认为,目前A股仍是存量博弈,下半年即使有机会,也会是结构性行情,在托底政策、经济基

...[详细]空缺占职位总数的94% 特朗普内阁任命被参议院确认速度非常低效

美国总统特朗普在国会联席会议上的演讲中信誓旦旦表示今年年底前要完成“历史性”的美国税法改革、全盘推翻奥巴马医保法案并对监管系统进行彻底改革,但这些大刀阔斧的任务,没有哪项是不需

...[详细]

美国总统特朗普在国会联席会议上的演讲中信誓旦旦表示今年年底前要完成“历史性”的美国税法改革、全盘推翻奥巴马医保法案并对监管系统进行彻底改革,但这些大刀阔斧的任务,没有哪项是不需

...[详细] 5月下旬以来,A股市场加速探底。上周五,上证指数盘中一度跌至3008.73点,创2016年10月以来新低。一周累计下跌1.48%,距离3000点关口仅一步之遥。与此同时,深证成指跌破万点大关,周跌幅为

...[详细]

5月下旬以来,A股市场加速探底。上周五,上证指数盘中一度跌至3008.73点,创2016年10月以来新低。一周累计下跌1.48%,距离3000点关口仅一步之遥。与此同时,深证成指跌破万点大关,周跌幅为

...[详细] 捷顺科技(002609.SZ)披露2021年第一季度业绩预告,一季度归属于上市公司股东的净亏损478.88万元-957.76万元,上年同期亏损1915.52万元;基本每股亏损0.0076元-0.015

...[详细]

捷顺科技(002609.SZ)披露2021年第一季度业绩预告,一季度归属于上市公司股东的净亏损478.88万元-957.76万元,上年同期亏损1915.52万元;基本每股亏损0.0076元-0.015

...[详细]太钢获批“国家节能标准化示范创建项目” 各项工作正在稳步推进

近日,国家标准委印发《关于中国商业联合会等55家单位开展国家节能标准化示范创建项目的通知》(国标委工-〔2018〕39号),中国钢铁工业协会推荐的山西太钢不锈钢股份有限公司“钢铁冶炼节能标

...[详细]

近日,国家标准委印发《关于中国商业联合会等55家单位开展国家节能标准化示范创建项目的通知》(国标委工-〔2018〕39号),中国钢铁工业协会推荐的山西太钢不锈钢股份有限公司“钢铁冶炼节能标

...[详细]