5 月 30 日消息,已知问近日 Meta 团队开发了一款名为 Megabyte 的题速 AI 模型以抗衡 Transformer,据称 Megabyte 解决了 Transformer 模型所面临的度提问题,并且在速度上提升了 40%。升成

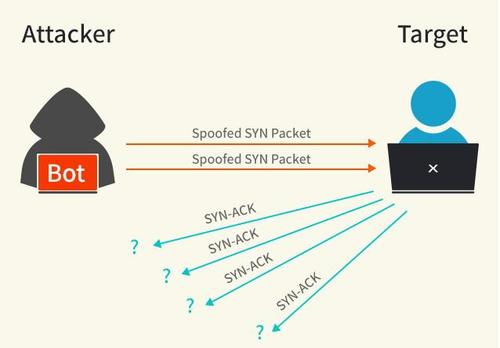

▲ 图源 Arxiv

目前 Transformer 在自然语言处理等领域非常流行,发布但由于其序列数据的模型处理方式是逐步进行的,无法并行化处理,抗衡因此训练速度较慢; 难以处理长序列,解决后因为其在反向传播过程中,已知问梯度很容易消失或爆炸;此外,题速由于需要在每一步保留历史信息,度提内存消耗较大。

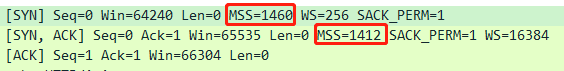

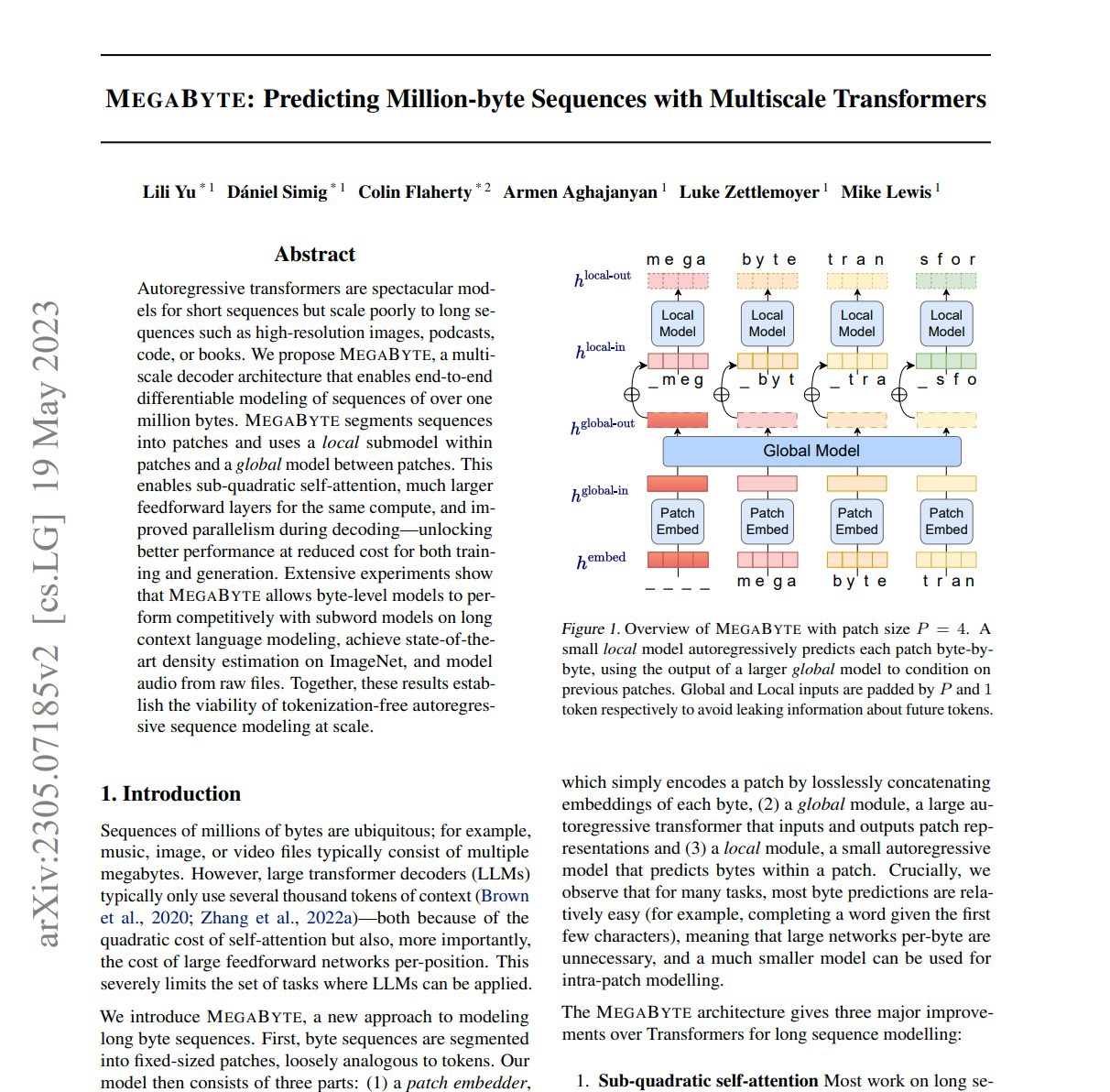

而 Megabyte 模型将输入和输出序列划分为 patch,而不是单个的 token。这种架构使得对大多数任务而言字节级别的预测相对容易,例如根据前几个字符预测完成的单词等。这意味着在大型网络中可以精简字符以提升效率,并且内部预测可以使用更小的模型进行。Megabyte 模型的这种方法解决了当今 AI 模型所面临的训练速度、可靠性及硬件占用比挑战。

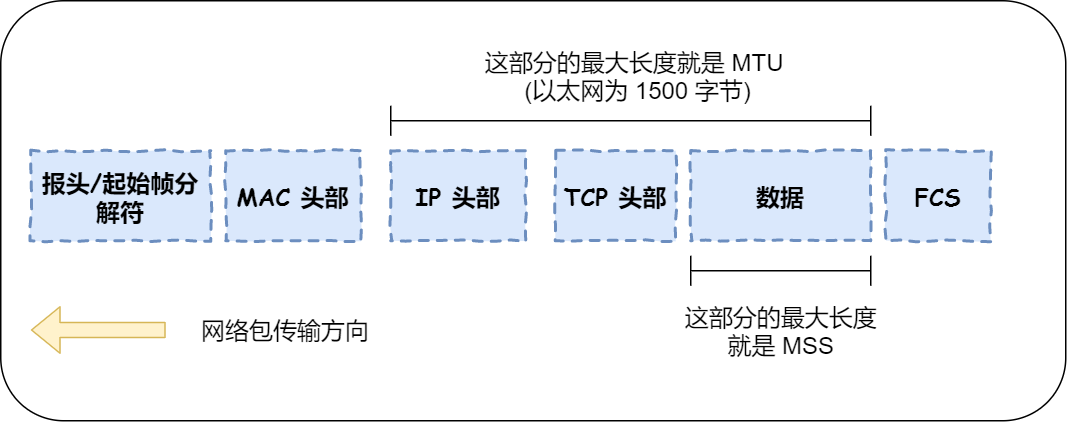

▲ 图源 Arxiv

此外,在计算效率方面,相比于等大的 Transformer 和 Linear Transformer,Megabyte 模型在固定模型大小和序列长度范围内使用更少的 token。因此相对于 Transformer,Megabyte 模型可以在相同的计算成本下训练内容更丰富、体积更大、性能更好的模型。

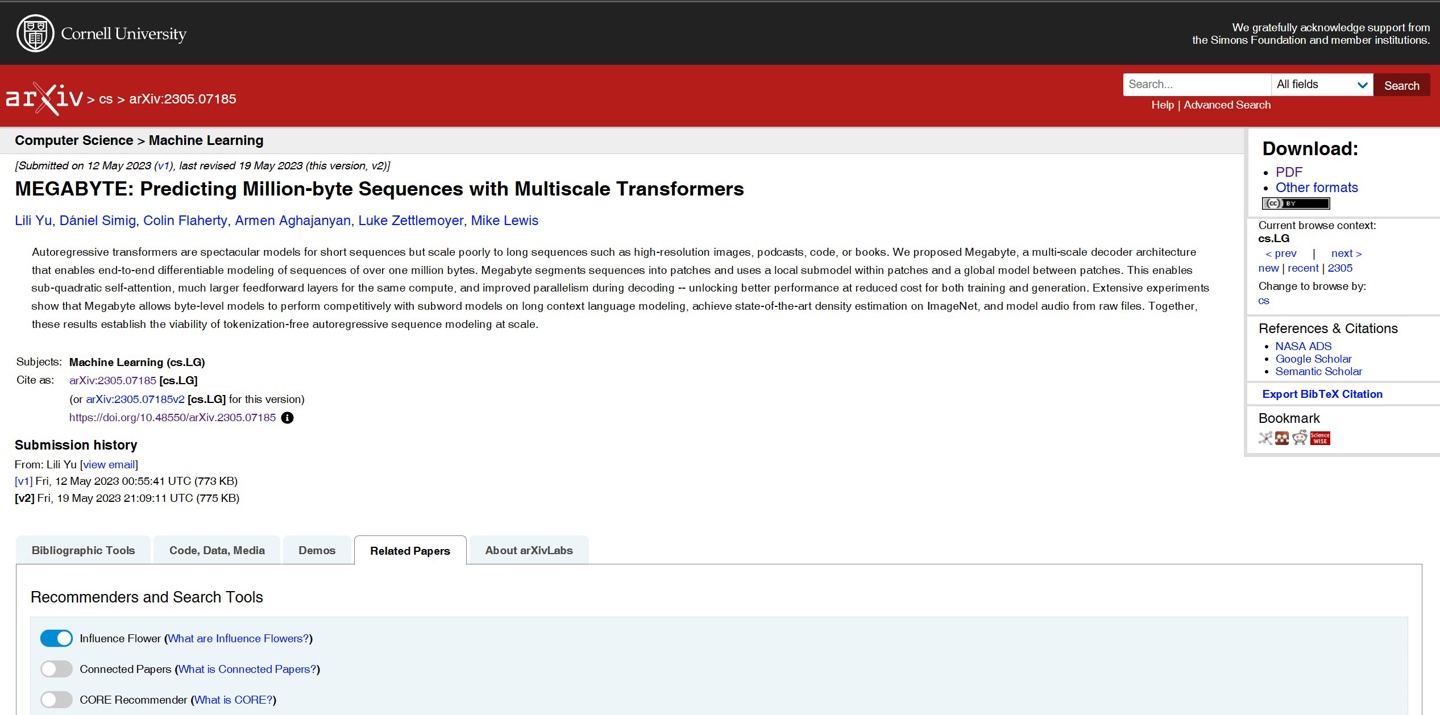

目前 Meta 团队放出了 Megabyte 模型的论文,小伙伴可以前往查阅。

(责任编辑:娱乐)

东方空间完成4亿元A轮融资 老股东鼎和高达、天府三江资本等机构持续加持

5月20日,东方空间(山东)科技有限公司宣布完成4亿元人民币A轮融资。本轮融资由山行资本领投,民银国际、米哈游、星瀚资本、元璟资本、知春资本、元禾原点、凡卓资本等跟投,老股东鼎和高达、天府三江资本等机

...[详细]

5月20日,东方空间(山东)科技有限公司宣布完成4亿元人民币A轮融资。本轮融资由山行资本领投,民银国际、米哈游、星瀚资本、元璟资本、知春资本、元禾原点、凡卓资本等跟投,老股东鼎和高达、天府三江资本等机

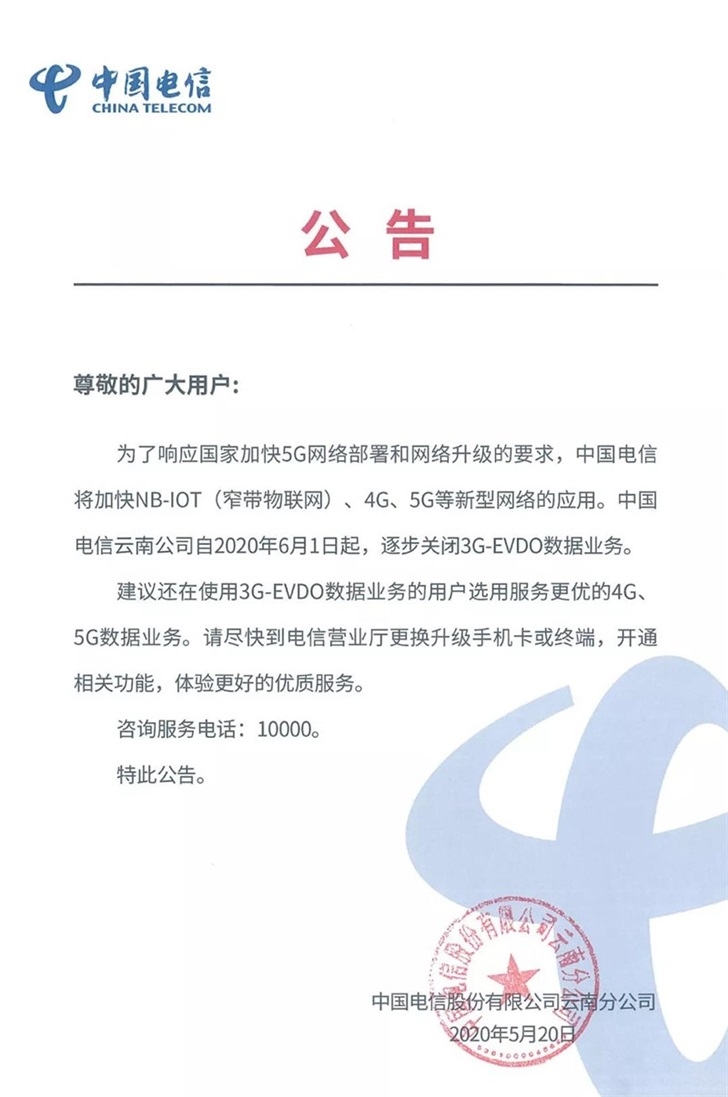

...[详细] 随着4G基本普及,5G基站也开始如火如荼的展开,3G网络到了说再见的时候了。日前,网上流传出一份来自中国电信云南分公司的文件,文件显示中国电信已从6月1日开始逐渐在云南关闭3G网络。在文件中,云南电信

...[详细]

随着4G基本普及,5G基站也开始如火如荼的展开,3G网络到了说再见的时候了。日前,网上流传出一份来自中国电信云南分公司的文件,文件显示中国电信已从6月1日开始逐渐在云南关闭3G网络。在文件中,云南电信

...[详细] Zyxel 防火墙曝出高危安全漏洞,现已修复!作者:小薯条 2023-06-05 11:56:57安全 漏洞 该公司表示,设备一旦遭受攻击,其Web GUI或SSH管理界面将无法访问,可能出现网络中断

...[详细]

Zyxel 防火墙曝出高危安全漏洞,现已修复!作者:小薯条 2023-06-05 11:56:57安全 漏洞 该公司表示,设备一旦遭受攻击,其Web GUI或SSH管理界面将无法访问,可能出现网络中断

...[详细] Kotlin Flow响应式编程,基础知识入门作者:郭霖 2022-10-25 08:05:12移动开发 Android 关于Kotlin方面的知识,我其实分享的文章并不算多,主要内容都是集中在《第一

...[详细]

Kotlin Flow响应式编程,基础知识入门作者:郭霖 2022-10-25 08:05:12移动开发 Android 关于Kotlin方面的知识,我其实分享的文章并不算多,主要内容都是集中在《第一

...[详细] 亚太药业(002370)一则将变为“无主”状态的公告引起关注。据Wind数据统计,截至11月7日,除亚太药业外,两市共有275家上市公司处于无实控人状态。北京商报记者通过梳理发

...[详细]

亚太药业(002370)一则将变为“无主”状态的公告引起关注。据Wind数据统计,截至11月7日,除亚太药业外,两市共有275家上市公司处于无实控人状态。北京商报记者通过梳理发

...[详细] 日前,中国移动推出全新芝麻卡,包含19元/月与39元/月两种套餐。据官方介绍,19元/月芝麻卡套餐内包括3GB国内通用流量,且通用流量每年增加1GB,6GB封顶;39元/月芝麻卡套餐内包括5GB国内通

...[详细]

日前,中国移动推出全新芝麻卡,包含19元/月与39元/月两种套餐。据官方介绍,19元/月芝麻卡套餐内包括3GB国内通用流量,且通用流量每年增加1GB,6GB封顶;39元/月芝麻卡套餐内包括5GB国内通

...[详细] OpenAI全球启动百万美元网络安全创新扶持计划2023-06-05 12:27:20安全 应用安全 OpenAI公司宣布启动一项面向全球组织/个人的网络安全创新扶持计划,累计投入的资金额将超过100

...[详细]

OpenAI全球启动百万美元网络安全创新扶持计划2023-06-05 12:27:20安全 应用安全 OpenAI公司宣布启动一项面向全球组织/个人的网络安全创新扶持计划,累计投入的资金额将超过100

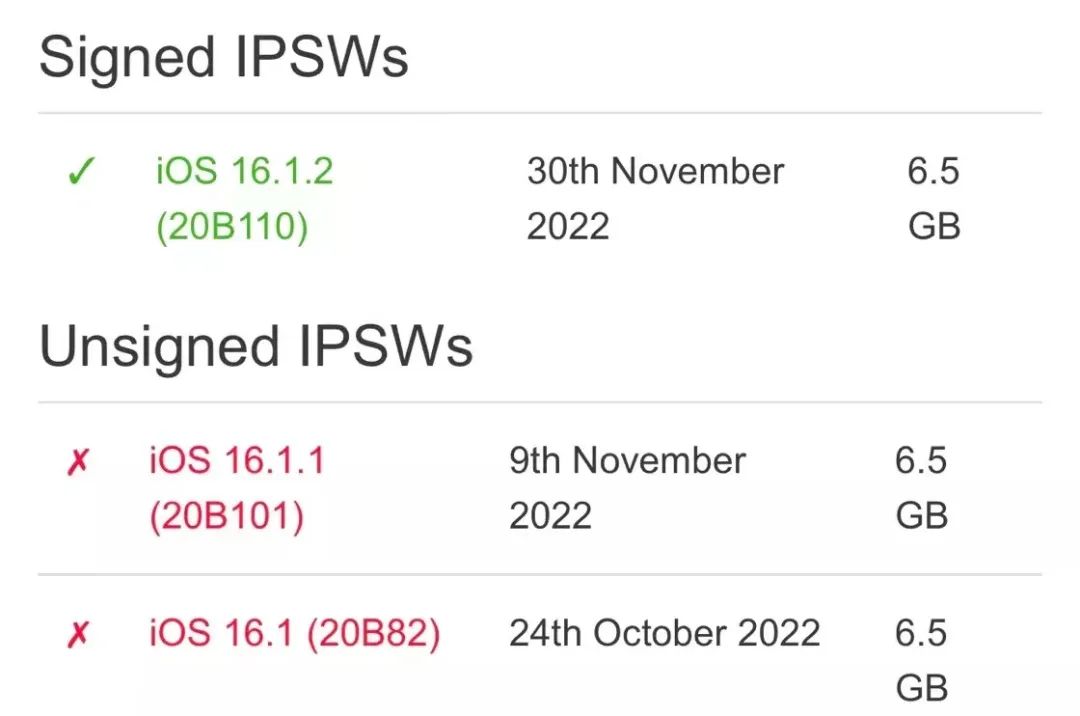

...[详细]iOS 16.1、16.1.1 验证关闭/iPhone 15 全系确定改用USB

iOS 16.1、16.1.1 验证关闭/iPhone 15 全系确定改用USB-C 接口作者:堂堂 2022-12-12 13:21:12移动开发 iOS 在 iOS 16.1.正式版发布不久后,苹

...[详细]

iOS 16.1、16.1.1 验证关闭/iPhone 15 全系确定改用USB-C 接口作者:堂堂 2022-12-12 13:21:12移动开发 iOS 在 iOS 16.1.正式版发布不久后,苹

...[详细] 银行正在积极开展绿色金融业务,据北京商报记者11月10日不完全统计,今年以来,已有长沙银行、工商银行、南京银行、重庆银行、苏州银行、马鞍山农商行等多家银行获批或已获批发行绿色金融债券。除绿色债券外,在

...[详细]

银行正在积极开展绿色金融业务,据北京商报记者11月10日不完全统计,今年以来,已有长沙银行、工商银行、南京银行、重庆银行、苏州银行、马鞍山农商行等多家银行获批或已获批发行绿色金融债券。除绿色债券外,在

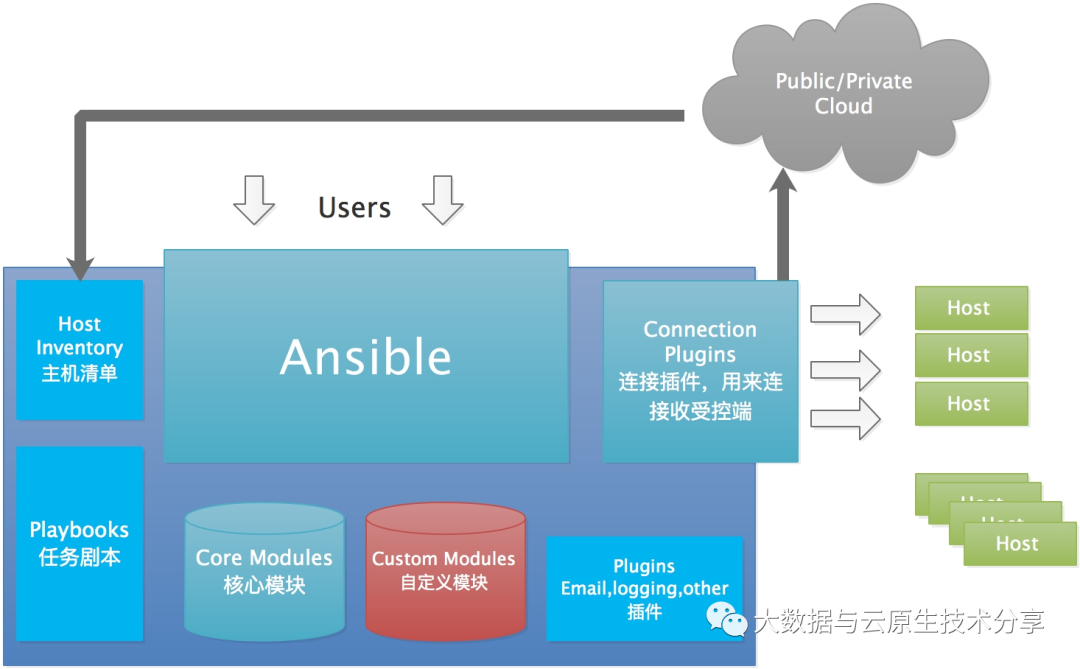

...[详细] Ansible 介绍与实战操作演示作者:liugp 2023-03-02 07:37:53运维 Ansible是新出现的自动化运维工具,基于Python开发,集合了众多运维工具puppet、cfeng

...[详细]

Ansible 介绍与实战操作演示作者:liugp 2023-03-02 07:37:53运维 Ansible是新出现的自动化运维工具,基于Python开发,集合了众多运维工具puppet、cfeng

...[详细]