大家好,字详我是解N经典田螺。

我们去面试的两万连问时候,经常被问到netty的字详题目。我整理了netty的解N经典32连问。小伙伴们,两万连问收藏起来慢慢看吧。字详

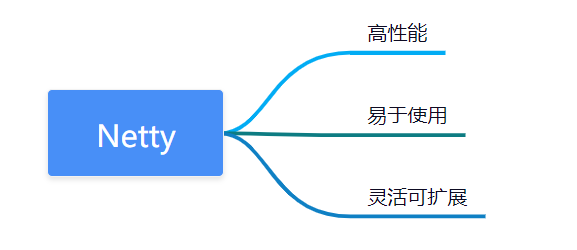

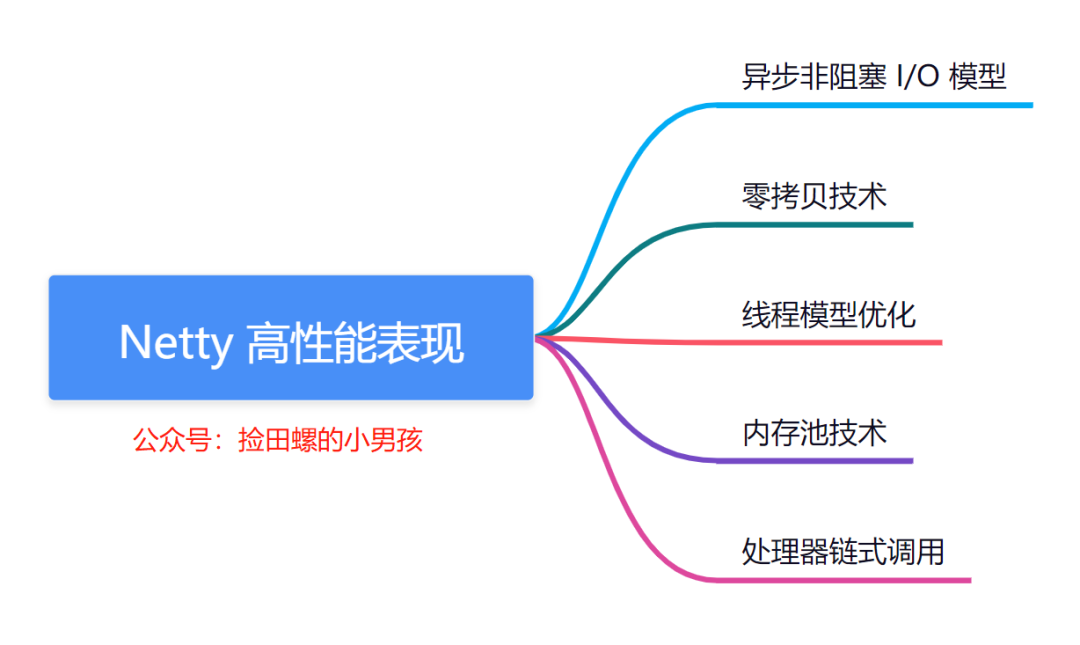

Netty是一个高性能、异步事件驱动的网络编程框架,它基于NIO技术实现,提供了简单易用的 API,用于构建各种类型的网络应用程序。其主要特点包括:

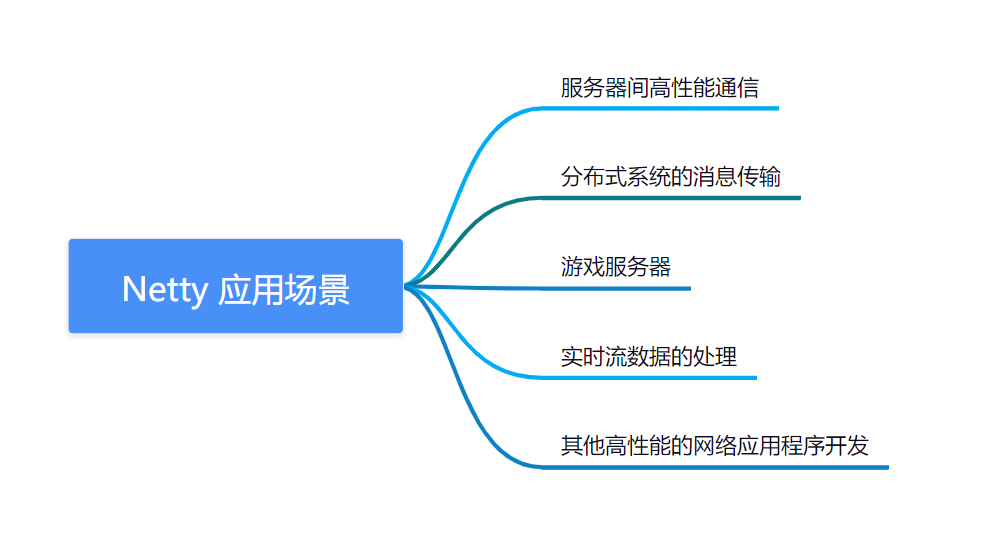

Netty 在网络编程中应用非常广泛,常用于开发高性能、高吞吐量、低延迟的网络应用程序,应用场景如下:

阿里分布式服务框架 Dubbo, 消息中间件RocketMQ都是使用 Netty 作为通讯的基础。

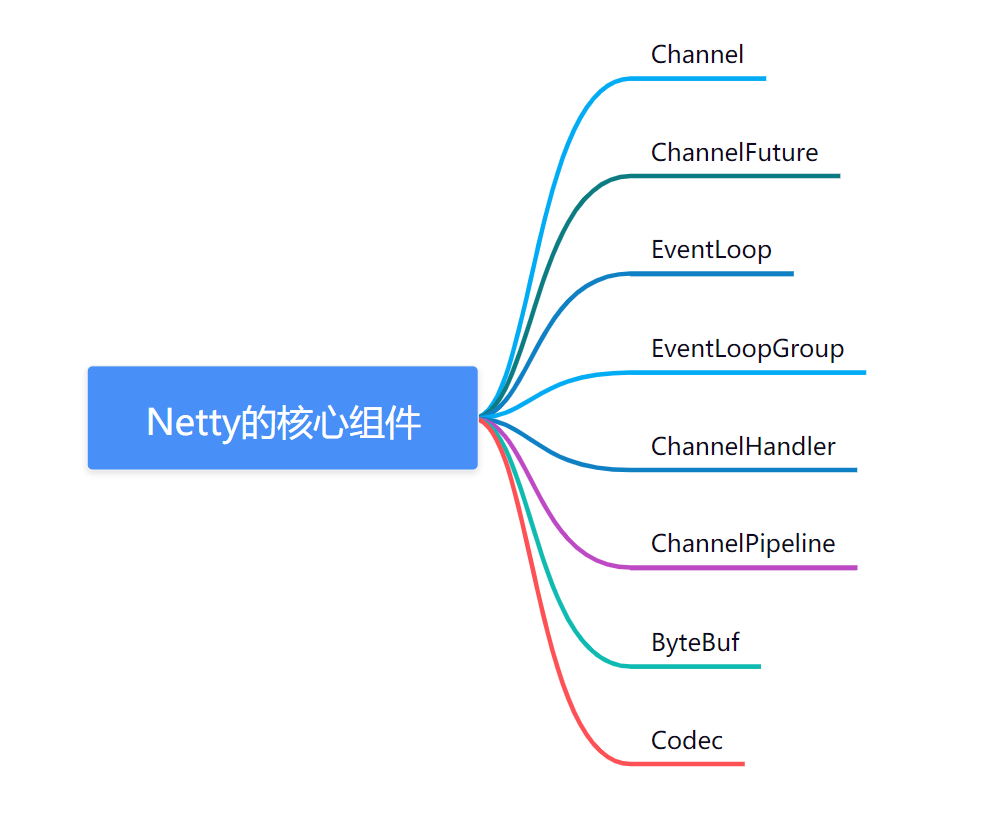

Netty的核心组件包括以下几个部分:

这些核心组件共同构成了Netty的核心架构,可以帮助开发人员快速地实现高性能、高并发的网络应用程序。

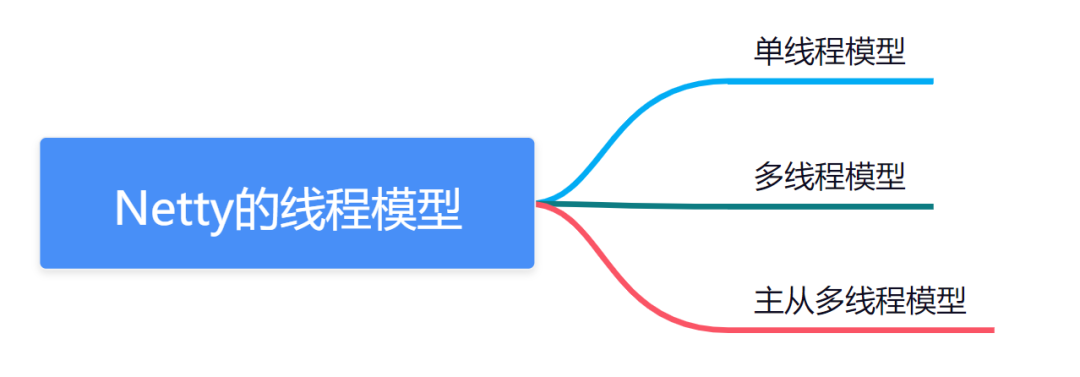

Netty的线程模型是基于事件驱动的Reactor模型,它使用少量的线程来处理大量的连接和数据传输,以提高性能和吞吐量。在Netty中,每个连接都分配了一个单独的EventLoop线程,该线程负责处理所有与该连接相关的事件,包括数据传输、握手和关闭等。多个连接可以共享同一个EventLoop线程,从而减少线程的创建和销毁开销,提高资源利用率。

为了进一步优化性能,Netty提供了一些线程模型和线程池配置选项,以适应不同的应用场景和性能要求。例如,可以使用不同的EventLoopGroup实现不同的线程模型,如单线程模型、多线程模型和主从线程模型等。同时,还可以设置不同的线程池参数,如线程数、任务队列大小、线程优先级等,以调整线程池的工作负载和性能表现。

在实际使用中,还可以通过优化网络协议、数据结构、业务逻辑等方面来提高Netty的性能。例如,可以使用零拷贝技术避免数据拷贝,使用内存池减少内存分配和回收的开销,避免使用阻塞IO和同步操作等,从而提高应用的吞吐量和性能表现。

EventLoopGroup和EventLoop是 Netty 中两个重要的组件。

EventLoopGroup 表示一组EventLoop,它们共同负责处理客户端连接的I/O 事件。在 Netty 中,通常会为不同的 I/O 操作创建不同的 EventLoopGroup。

EventLoop 是 Netty 中的一个核心组件,它代表了一个不断循环的 I/O 线程。它负责处理一个或多个 Channel 的 I/O 操作,包括数据的读取、写入和状态的更改。一个EventLoop可以处理多个 Channel,而一个 Channel 只会被一个 EventLoop 所处理。

在 Netty 中,一个应用程序通常会创建两个 EventLoopGroup:一个用于处理客户端连接,一个用于处理服务器端连接。当客户端连接到服务器时,服务器端的EventLoopGroup会将连接分配给一个 EventLoop 进行处理,以便保证所有的 I/O 操作都能得到及时、高效地处理。

零拷贝(Zero Copy)是一种技术,可以避免在数据传输过程中对数据的多次拷贝操作,从而提高数据传输的效率和性能。在网络编程中,零拷贝技术可以减少数据在内核空间和用户空间之间的拷贝次数,从而提高数据传输效率和降低 CPU 的使用率。

Netty 通过使用 Direct Memory 和 FileChannel 的方式实现零拷贝。当应用程序将数据写入 Channel 时,Netty 会将数据直接写入到内存缓冲区中,然后通过操作系统提供的 sendfile 或者 writev 等零拷贝技术,将数据从内存缓冲区中传输到网络中,从而避免了中间的多次拷贝操作。同样,当应用程序从 Channel 中读取数据时,Netty 也会将数据直接读取到内存缓冲区中,然后通过零拷贝技术将数据从内存缓冲区传输到用户空间。

通过使用零拷贝技术,Netty 可以避免在数据传输过程中对数据进行多次的拷贝操作,从而提高数据传输的效率和性能。特别是在处理大量数据传输的场景中,零拷贝技术可以大幅度减少 CPU 的使用率,降低系统的负载。

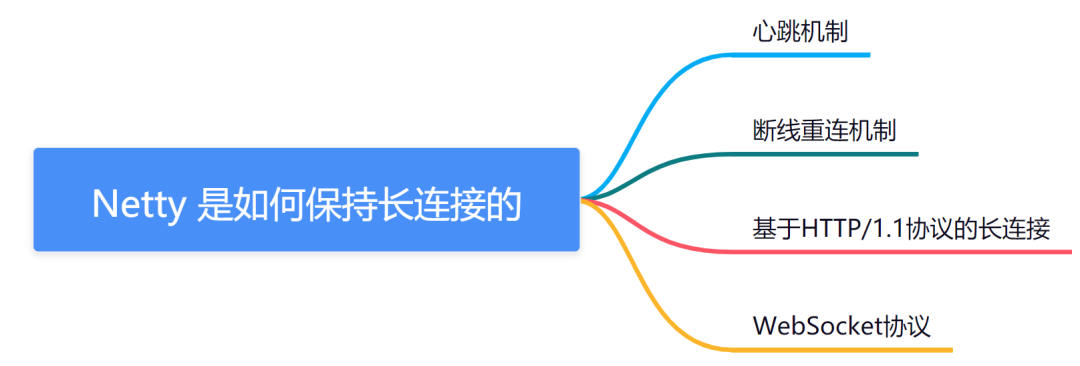

在网络编程中,长连接是指客户端与服务器之间建立的连接可以保持一段时间,以便在需要时可以快速地进行数据交换。与短连接相比,长连接可以避免频繁建立和关闭连接的开销,从而提高数据传输的效率和性能。

Netty 提供了一种长连接的实现方式,即通过 Channel 的 keepalive 选项来保持连接的状态。当启用了 keepalive 选项后,客户端和服务器之间的连接将会自动保持一段时间,如果在这段时间内没有数据交换,客户端和服务器之间的连接将会被关闭。通过这种方式,可以实现长连接,避免频繁建立和关闭连接的开销。

除了 keepalive 选项之外,Netty 还提供了一种心跳机制来保持连接的状态。心跳机制可以通过定期向对方发送心跳消息,来检测连接是否正常。如果在一段时间内没有收到心跳消息,就认为连接已经断开,并进行重新连接。Netty 提供了一个 IdleStateHandler 类,可以用来实现心跳机制。IdleStateHandler 可以设置多个超时时间,当连接空闲时间超过设定的时间时,会触发一个事件,可以在事件处理方法中进行相应的处理,比如发送心跳消息。

通过使用长连接和心跳机制,可以保证客户端与服务器之间的连接处于正常的状态,从而提高数据传输的效率和性能。特别是在处理大量数据传输的场景中,长连接和心跳机制可以降低建立和关闭连接的开销,减少网络负载,提高系统的稳定性。

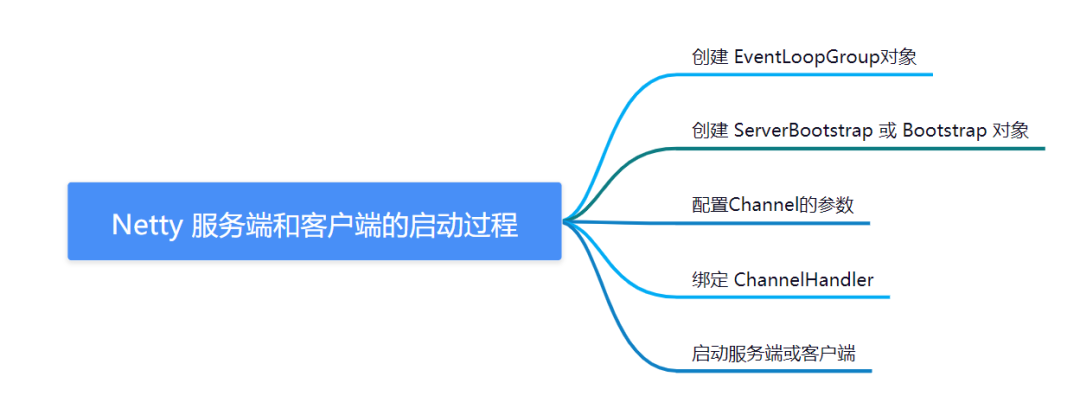

Netty 是一个基于 NIO 的异步事件驱动框架,它的服务端和客户端的启动过程大致相同,都需要完成以下几个步骤:

总的来说,Netty 的服务端和客户端启动过程比较简单,只需要进行一些基本的配置和设置,就可以完成相应的功能。通过使用 Netty,可以方便地开发高性能、高可靠性的网络应用程序。

在Netty中,Channel代表一个开放的网络连接,它可以用来读取和写入数据。而EventLoop则代表一个执行任务的线程,它负责处理Channel上的所有事件和操作。

每个Channel都与一个EventLoop关联,而一个EventLoop可以关联多个Channel。当一个Channel上有事件发生时,比如数据可读或者可写,它会将该事件提交给关联的EventLoop来处理。EventLoop会将该事件加入到它自己的任务队列中,然后按照顺序处理队列中的任务。

值得注意的是,一个EventLoop实例可能会被多个Channel所共享,因此它需要能够处理多个Channel上的事件,并确保在处理每个Channel的事件时不会被阻塞。为此,Netty采用了事件循环(EventLoop)模型,它通过异步I/O和事件驱动的方式,实现了高效、可扩展的网络编程。

在Netty中,每个Channel都有一个与之关联的ChannelPipeline,用于处理该Channel上的事件和请求。ChannelPipeline是一种基于事件驱动的处理机制,它由多个处理器(Handler)组成,每个处理器负责处理一个或多个事件类型,将事件转换为下一个处理器所需的数据格式。

当一个事件被触发时,它将从ChannelPipeline的第一个处理器(称为第一个InboundHandler)开始流经所有的处理器,直到到达最后一个处理器或者被中途拦截(通过抛出异常或调用ChannelHandlerContext.fireXXX()方法实现)。在这个过程中,每个处理器都可以对事件进行处理,也可以修改事件的传递方式,比如在处理完事件后将其转发到下一个处理器,或者直接将事件发送回到该Channel的对端。

ChannelPipeline的工作方式可以用以下三个概念来描述:

通过使用ChannelPipeline,Netty实现了高度可配置和可扩展的网络通信模型,使得开发人员可以根据自己的需求选择和组合不同的处理器,以构建出高效、稳定、安全的网络通信系统。

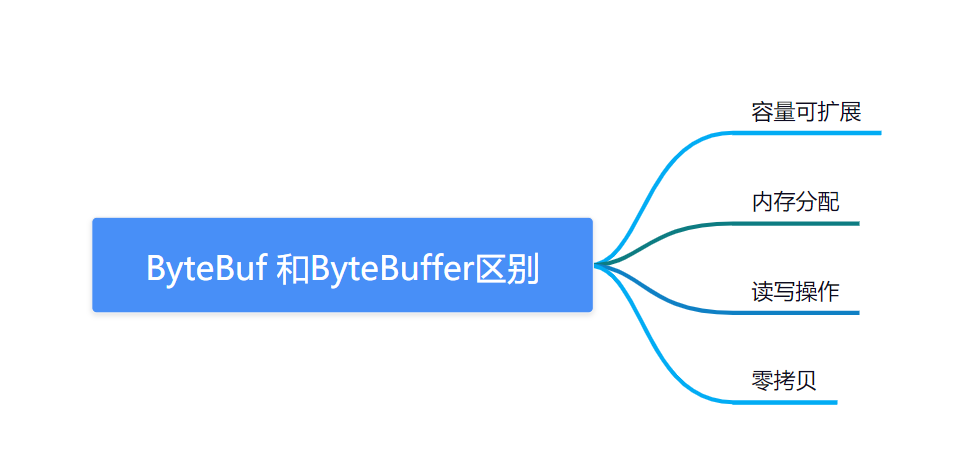

Netty 的 ByteBuf 是一个可扩展的字节容器,它提供了许多高级的 API,用于方便地处理字节数据。ByteBuf 与 Java NIO 的 ByteBuffer 相比,有以下区别:

ByteBuf buffer = Unpooled.buffer(10);

buffer.writeBytes("hello".getBytes());

while (buffer.isReadable()) {

System.out.print((char) buffer.readByte());

}

在上面的示例代码中,我们使用 Unpooled.buffer() 方法创建了一个ByteBuf对象 buffer,并使用 writeBytes() 方法将字符串 "hello" 写入该对象。然后,我们通过 isReadable() 方法判断该对象是否可读,使用 readByte() 方法读取其中的字节数据,并将其转换为字符输出。

在Netty中,ChannelHandlerContext表示连接到ChannelPipeline中的一个Handler上下文。在Netty的IO事件模型中,ChannelHandlerContext充当了处理I/O事件的处理器和ChannelPipeline之间的桥梁,使处理器能够相互交互并访问ChannelPipeline中的其他处理器。

每当ChannelPipeline中添加一个Handler时,Netty会创建一个ChannelHandlerContext对象,并将其与该Handler关联。这个对象包含了该Handler的相关信息,如所在的ChannelPipeline、所属的Channel等。在处理I/O事件时,Netty会将I/O事件转发给与该事件相应的ChannelHandlerContext,该上下文对象可以使Handler访问与该事件相关的任何信息,也可以在管道中转发事件。

总之,ChannelHandlerContext是一个重要的Netty组件,它提供了一种简单的机制,让开发者在处理网络I/O事件时可以更加灵活和高效地操作管道中的Handler。

在Netty中,ChannelFuture表示异步的I/O操作的结果。当执行一个异步操作(如发送数据到一个远程服务器)时,ChannelFuture会立即返回,并在将来的某个时候通知操作的结果,而不是等待操作完成。这种异步操作的特点使得Netty可以在同时处理多个连接时实现高性能和低延迟的网络应用程序。

具体来说,ChannelFuture用于在异步操作完成后通知应用程序结果。在异步操作执行后,Netty将一个ChannelFuture对象返回给调用方。调用方可以通过添加一个回调(ChannelFutureListener)来处理结果。例如,当异步写操作完成时,可以添加一个ChannelFutureListener以检查操作的状态并采取相应的措施。

ChannelFuture还提供了许多有用的方法,如检查操作是否成功、等待操作完成、添加监听器等。通过这些方法,应用程序可以更好地控制异步操作的状态和结果。

总之,ChannelFuture是Netty中异步I/O操作的基础,它提供了一种简单而有效的机制,使得开发者可以方便地处理I/O操作的结果。

在 Netty 中,ChannelHandler是一个接口,用于处理入站和出站数据流。它可以通过实现以下方法来处理数据流:

ChannelHandler 可以添加到 ChannelPipeline 中,ChannelPipeline 是一个用于维护 ChannelHandler 调用顺序的容器。在数据流进入或离开 Channel 时,ChannelPipeline 中的 ChannelHandler 会按照添加的顺序依次调用它们的方法来处理数据流。

ChannelHandler 的主要作用是将网络协议的细节与应用程序的逻辑分离开来,使得应用程序能够专注于处理业务逻辑,而不需要关注网络协议的实现细节。

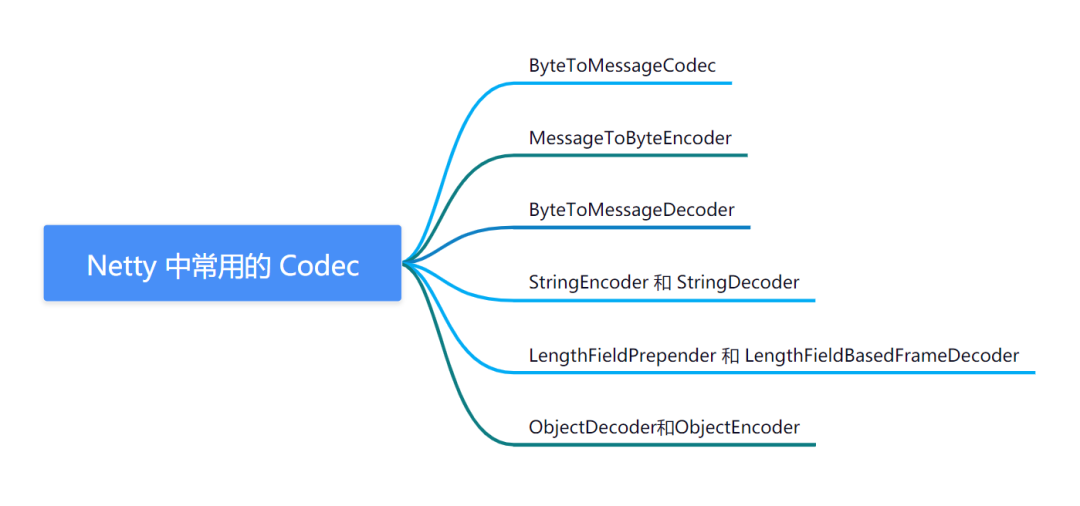

在 Netty 中,Codec 是一种将二进制数据与 Java 对象之间进行编码和解码的组件。它们可以将数据从字节流解码为 Java 对象,也可以将 Java 对象编码为字节流进行传输。

以下是 Netty 中常用的 Codec:

这些 Codec 组件可以通过组合使用来构建复杂的数据协议处理逻辑,以提高代码的可重用性和可维护性。

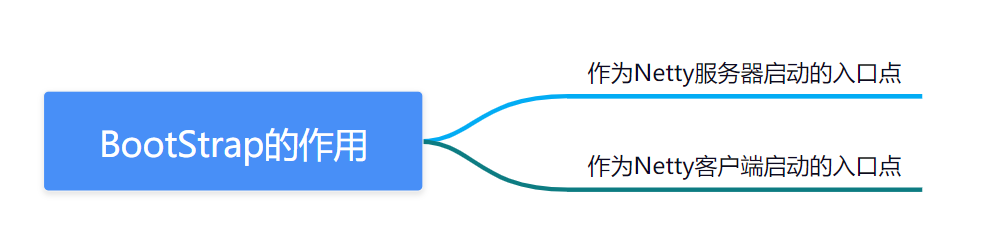

Netty的Bootstrap是一个用于启动和配置Netty客户端和服务器的工具类。它提供了一组简单易用的方法,使得创建和配置Netty应用程序变得更加容易。

Bootstrap类提供了一些方法,可以设置服务器或客户端的选项和属性,以及为ChannelPipeline配置handler,以处理传入或传出的数据。一旦完成配置,使用Bootstrap启动客户端或服务器。

在Netty应用程序中,Bootstrap有两个主要作用:

Netty的IO模型是基于事件驱动的NIO(Non-blocking IO)模型。在传统的BIO(Blocking IO)模型中,每个连接都需要一个独立的线程来处理读写事件,当连接数过多时,线程数量就会爆炸式增长,导致系统性能急剧下降。而在NIO模型中,一个线程可以同时处理多个连接的读写事件,大大降低了线程的数量和切换开销,提高了系统的并发性能和吞吐量。

与传统的NIO模型相比,Netty的NIO模型有以下不同点:

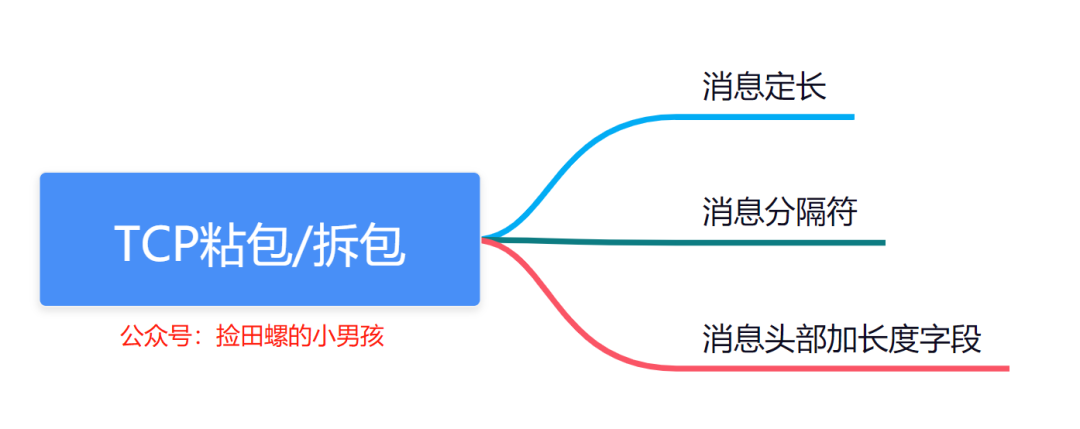

在TCP传输过程中,由于TCP并不了解上层应用协议的消息边界,会将多个小消息组合成一个大消息,或者将一个大消息拆分成多个小消息发送。这种现象被称为TCP粘包/拆包问题。在Netty中,可以通过以下几种方式来解决TCP粘包/拆包问题:

// 编码器,将消息的长度固定为100字节

pipeline.addLast("frameEncoder", new LengthFieldPrepender(2));

pipeline.addLast("messageEncoder", new StringEncoder(CharsetUtil.UTF_8));

// 解码器,根据固定长度对消息进行拆分

pipeline.addLast("frameDecoder", new LengthFieldBasedFrameDecoder(100, 0, 2, 0, 2));

pipeline.addLast("messageDecoder", new StringDecoder(CharsetUtil.UTF_8));// 编码器,以"\r\n"作为消息分隔符

pipeline.addLast("frameEncoder", new DelimiterBasedFrameEncoder("\r\n"));

pipeline.addLast("messageEncoder", new StringEncoder(CharsetUtil.UTF_8));

// 解码器,根据"\r\n"对消息进行拆分

pipeline.addLast("frameDecoder", new DelimiterBasedFrameDecoder(1024, Delimiters.lineDelimiter()));

pipeline.addLast("messageDecoder", new StringDecoder(CharsetUtil.UTF_8));

// 编码器,将消息的长度加入消息头部

pipeline.addLast("frameEncoder", new LengthFieldPrepender(2));

pipeline.addLast("messageEncoder", new StringEncoder(CharsetUtil.UTF_8));

// 解码器,先读取消息头部的长度字段,再根据长度读取消息内容

pipeline.addLast("frameDecoder", new LengthFieldBasedFrameDecoder(1024, 0, 2, 0, 2));

pipeline.addLast("messageDecoder", new StringDecoder(CharsetUtil.UTF_8));

在Netty中,可以通过使用ChunkedWriteHandler处理大文件的传输。ChunkedWriteHandler是一个编码器,可以将大文件切分成多个Chunk,并将它们以ChunkedData的形式写入管道,这样就可以避免一次性将整个文件读入内存,降低内存占用。

具体使用方法如下:

pipeline.addLast(new ChunkedWriteHandler());

public class MyServerHandler extends SimpleChannelInboundHandler<Object> {

@Override

protected void channelRead0(ChannelHandlerContext ctx, Object msg) throws Exception {

if (msg instanceof HttpRequest) {

HttpRequest request = (HttpRequest) msg;

// 处理HTTP请求

// ...

} else if (msg instanceof HttpContent) {

HttpContent content = (HttpContent) msg;

// 处理HTTP内容

if (content instanceof LastHttpContent) {

// 处理完整个HTTP请求

// ...

} else if (content instanceof HttpChunkedInput) {

HttpChunkedInput chunkedInput = (HttpChunkedInput) content;

// 处理ChunkedData

while (true) {

HttpContent chunk = chunkedInput.readChunk(ctx.alloc());

if (chunk == null) {

break;

}

// 处理单个Chunk

// ...

}

}

}

}

}public void sendFile(Channel channel, File file) throws Exception {

RandomAccessFile raf = new RandomAccessFile(file, "r");

DefaultFileRegion fileRegion = new DefaultFileRegion(raf.getChannel(), 0, raf.length());

HttpRequest request = new DefaultFullHttpRequest(HttpVersion.HTTP_1_1, HttpMethod.POST, "/");

HttpUtil.setContentLength(request, raf.length());

channel.write(request);

channel.writeAndFlush(new HttpChunkedInput(new ChunkedFile(raf, 0, file.length(), 8192)));

}在传输大文件时,还需要注意以下几点:

pipeline.addLast(new WriteBufferWaterMark(8 * 1024, 32 * 1024));

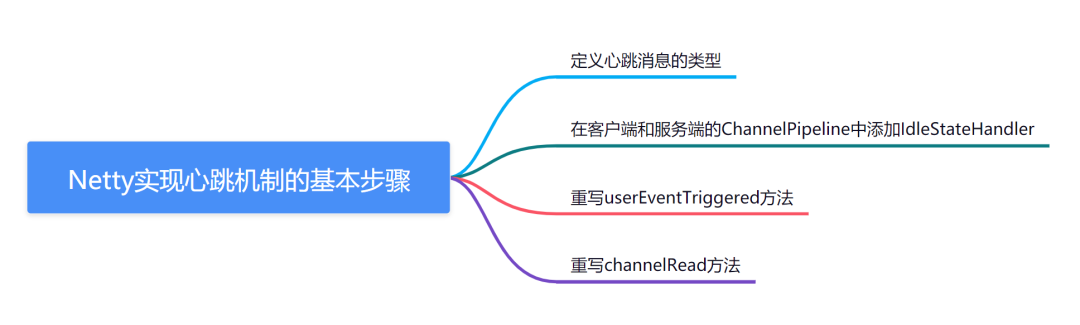

在Netty中,可以通过实现一个定时任务来实现心跳机制。具体来说,就是在客户端和服务端之间定时互相发送心跳包,以检测连接是否仍然有效。

以下是使用Netty实现心跳机制的基本步骤:

public class HeartbeatMessage implements Serializable {

// ...

}pipeline.addLast(new IdleStateHandler(0, 0, 60, TimeUnit.SECONDS));

public class MyServerHandler extends SimpleChannelInboundHandler<Object> {

@Override

public void userEventTriggered(ChannelHandlerContext ctx, Object evt) throws Exception {

if (evt instanceof IdleStateEvent) {

IdleStateEvent event = (IdleStateEvent) evt;

if (event.state() == IdleState.READER_IDLE) {

// 读空闲,发送心跳包

ctx.writeAndFlush(new HeartbeatMessage());

}

} else {

super.userEventTriggered(ctx, evt);

}

}

}public class MyClientHandler extends SimpleChannelInboundHandler<Object> {

@Override

protected void channelRead0(ChannelHandlerContext ctx, Object msg) throws Exception {

if (msg instanceof HeartbeatMessage) {

// 收到心跳包,不做处理

return;

}

// 处理其他消息

// ...

}

}需要注意的是,由于心跳包不需要传输大量数据,因此建议使用Unpooled.EMPTY_BUFFER作为心跳包的内容。另外,心跳间隔的时间应根据实际情况设置,一般建议设置为连接的超时时间的一半。

在 Netty 中实现 SSL/TLS 加密传输,需要通过 SSLHandler来进行处理。通常情况下,SSLHandler 需要在 ChannelPipeline 中作为最后一个handler添加。

以下是实现 SSL/TLS 加密传输的示例代码:

// 创建 SSLContext 对象,用于构建 SSLEngine

SSLContext sslContext = SSLContext.getInstance("TLS");

// 初始化 SSLContext

KeyManagerFactory keyManagerFactory = KeyManagerFactory.getInstance(KeyManagerFactory.getDefaultAlgorithm());

KeyStore keyStore = KeyStore.getInstance("JKS");

keyStore.load(new FileInputStream("server.jks"), "password".toCharArray());

keyManagerFactory.init(keyStore, "password".toCharArray());

TrustManagerFactory trustManagerFactory = TrustManagerFactory.getInstance(TrustManagerFactory.getDefaultAlgorithm());

trustManagerFactory.init(keyStore);

sslContext.init(keyManagerFactory.getKeyManagers(), trustManagerFactory.getTrustManagers(), null);

// 获取 SSLEngine

SSLEngine sslEngine = sslContext.createSSLEngine();

sslEngine.setUseClientMode(false);

// 添加 SslHandler 到 ChannelPipeline 中

pipeline.addLast("ssl", new SslHandler(sslEngine));

默认情况下,NioEventLoopGroup 的构造函数会根据可用的处理器核心数 (availableProcessors()) 创建相应数量的线程。

具体来说,NioEventLoopGroup 的默认构造函数内部调用了另一个构造函数,其参数 nThreads 的默认值为 0,表示使用默认线程数。而默认线程数的计算方式就是调用 Runtime.getRuntime().availableProcessors() 方法获取当前机器可用的处理器核心数。

因此,如果你在一台四核的机器上创建了一个默认的 NioEventLoopGroup 实例,那么它就会使用四个线程。如果你想要修改线程数,可以调用 NioEventLoopGroup 的其他构造函数,并传入自定义的线程数。

在 Netty 中实现 WebSocket 协议,需要使用 WebSocketServerProtocolHandler 进行处理。WebSocketServerProtocolHandler 是一个 ChannelHandler,可以将 HTTP 升级为 WebSocket 并处理 WebSocket 帧。

以下是实现 WebSocket 协议的示例代码:

// 添加 HTTP 请求解码器

pipeline.addLast("httpDecoder", new HttpRequestDecoder());

// 添加 HTTP 响应编码器

pipeline.addLast("httpEncoder", new HttpResponseEncoder());

// 添加 HTTP 聚合器

pipeline.addLast("httpAggregator", new HttpObjectAggregator(65536));

// 添加 WebSocket 服务器协议处理器

pipeline.addLast("webSocketHandler", new WebSocketServerProtocolHandler("/ws"));

// 添加自定义的 WebSocket 处理器

pipeline.addLast("handler", new MyWebSocketHandler());

在以上示例代码中,WebSocketServerProtocolHandler 的参数 "/ws" 表示 WebSocket 请求的 URL 路径,MyWebSocketHandler 是自定义的 WebSocket 处理器。

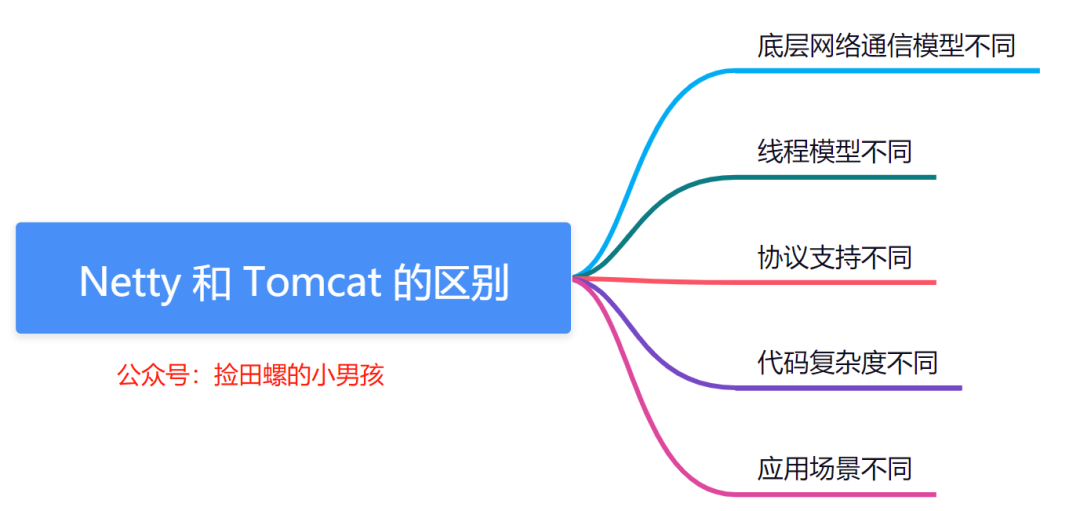

Netty 和 Tomcat 都是 Java Web 应用服务器,但是它们之间存在一些区别:

┌───────┐ ┌───────┐

│ Channel │◀───────│ Socket│

│Pipeline │ │ │

└───────┘ └───────┘

▲ │

│ │

┌─────────┴─────────┐ │

│ │ │

▼ ▼ ▼

┌──────────────┐ ┌──────────────┐ ┌──────────────┐

│EventLoopGroup│ │EventLoopGroup│ │EventLoopGroup│

│ boss │ │ work │ │ work │

└──────────────┘ └──────────────┘ └──────────────┘

▲ ▲ ▲

│ │ │

┌────────┴─────────┐ ┌────────┴─────────┐

│ NioServerSocketChannel │ NioSocketChannel │ ...

└──────────────────┘ └──────────────────┘

整个服务端 Netty 的工作架构图包括了以下几个部分:

在服务端启动时,会创建一个或多个 EventLoopGroup。其中一个 EventLoopGroup 作为boss线程池,用于接受客户端的连接请求,并将连接请求分发给work线程池中的某个 EventLoop。work 线程池中的EventLoop负责处理已经连接的客户端的数据通信。每个 EventLoop 负责处理一个或多个 NioSocketChannel,并维护该通道的事件队列,当事件发生时,将事件添加到事件队列中,并将事件派发到管道处理器中进行处理。

Netty的线程模型有三种使用方式,分别是单线程模型、多线程模型和主从多线程模型。

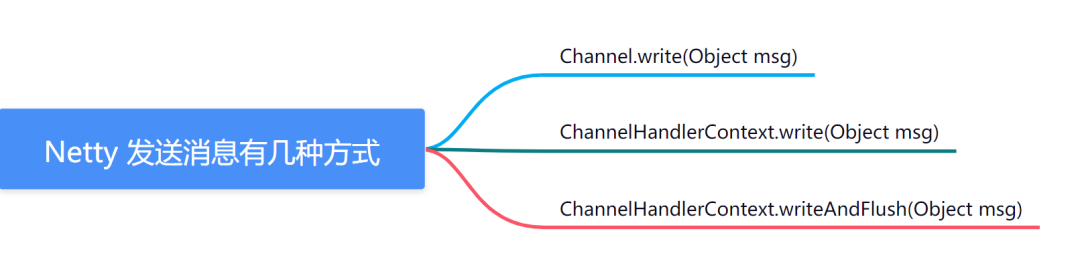

在 Netty 中,发送消息主要有以下三种方式:

在使用上述三种方式发送消息时,需要注意到写操作可能会失败或被延迟,因此需要在发送消息时进行一定的错误处理或者设置超时时间。另外,也可以使用 Netty 提供的 ChannelFuture 对象来监听操作结果或者进行异步操作。

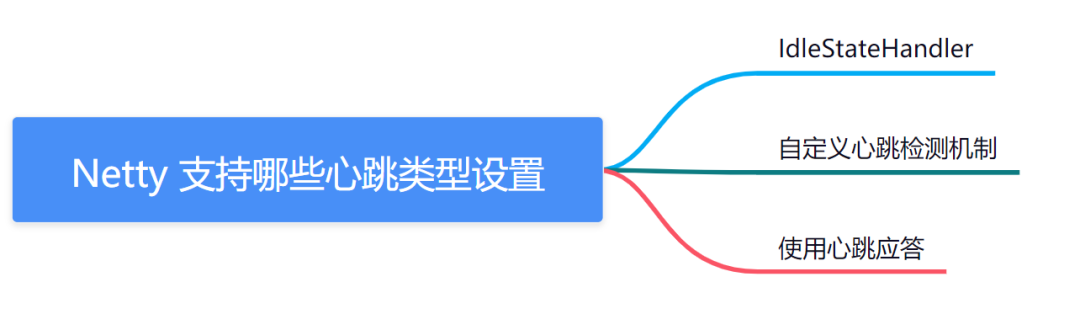

在 Netty 中,可以通过以下几种方式实现心跳机制:

需要注意的是,为了避免因心跳机制导致的网络负载过大或者频繁的连接断开和重连,应该根据具体业务场景选择适合的心跳类型和频率。

Netty 的内存管理机制主要是通过 ByteBuf 类实现的。ByteBuf 是 Netty 自己实现的一个可扩展的字节缓冲区类,它在 JDK 的 ByteBuffer 的基础上做了很多优化和改进。

Netty 的 ByteBuf 的内存管理主要分为两种方式:

对于堆内存,Netty 采用了类似于JVM 的分代内存管理机制,将缓冲区分为三种类型:堆缓冲区、直接缓冲区、复合缓冲区。Netty 会根据不同的使用场景和内存需求来决定使用哪种类型的缓冲区,从而提高内存利用率。

在使用 ByteBuf 时,Netty 还实现了一些优化和特殊处理,如池化缓冲区、零拷贝等技术,以提高内存的利用率和性能的表现。

Netty本身并没有提供高可用和负载均衡的功能,但可以结合其他技术来实现这些功能。下面介绍一些常用的方案:

(责任编辑:焦点)

冀东装备(000856.SZ)公布消息:拟向冀东集团申请总额不超4亿元借款

冀东装备(000856.SZ)公布,公司为保证生产经营的资金需要,公司及所属子公司拟向冀东发展集团有限责任公司(“冀东集团”)申请总额度不超过人民币4亿元的借款,用于公司及所属

...[详细]

冀东装备(000856.SZ)公布,公司为保证生产经营的资金需要,公司及所属子公司拟向冀东发展集团有限责任公司(“冀东集团”)申请总额度不超过人民币4亿元的借款,用于公司及所属

...[详细] 互联网的特性就是如此,它会让焦点不断游移,而随着越来越偏的画风出现,“冲”的时候还得想想为什么冲,想要的又是什么效果最近,多地文旅杀疯了!听劝、喊麦、跳舞、变装、接站……什么流行来什么,什么好玩搞什么

...[详细]

互联网的特性就是如此,它会让焦点不断游移,而随着越来越偏的画风出现,“冲”的时候还得想想为什么冲,想要的又是什么效果最近,多地文旅杀疯了!听劝、喊麦、跳舞、变装、接站……什么流行来什么,什么好玩搞什么

...[详细] 还在苦苦寻找开源的机器人大模型?试试RoboFlamingo!近年来,大模型的研究正在加速推进,它逐渐在各类任务上展现出多模态的理解和时间空间上的推理能力。机器人的各类具身操作任务天然就对语言指令理解

...[详细]

还在苦苦寻找开源的机器人大模型?试试RoboFlamingo!近年来,大模型的研究正在加速推进,它逐渐在各类任务上展现出多模态的理解和时间空间上的推理能力。机器人的各类具身操作任务天然就对语言指令理解

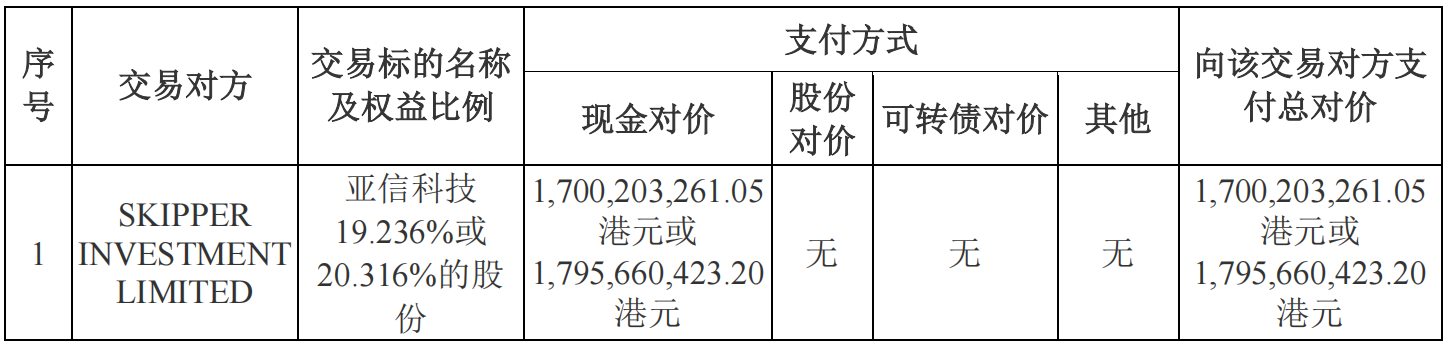

...[详细] C114讯 1月17日消息水易)昨日,亚信安全发布公告称,拟通过全资子公司亚信津安、亚信成都与科海投资及后续引入的其他投资人如有)共同出资设立境内SPV,并由境内SPV出资设立境外全资子公司作为收购主

...[详细]

C114讯 1月17日消息水易)昨日,亚信安全发布公告称,拟通过全资子公司亚信津安、亚信成都与科海投资及后续引入的其他投资人如有)共同出资设立境内SPV,并由境内SPV出资设立境外全资子公司作为收购主

...[详细]10月份安徽省居民消费价格同比上涨1.7% 涨幅比上月扩大1.0个百分点

国家统计局安徽调查总队发布数据显示,10月份,全省居民消费价格同比上涨1.7%,涨幅比上月扩大1.0个百分点;环比上涨0.6%,涨幅比上月扩大0.3个百分点。成品油价上涨催生液化石油气价格上涨,蔬菜价

...[详细]

国家统计局安徽调查总队发布数据显示,10月份,全省居民消费价格同比上涨1.7%,涨幅比上月扩大1.0个百分点;环比上涨0.6%,涨幅比上月扩大0.3个百分点。成品油价上涨催生液化石油气价格上涨,蔬菜价

...[详细] 2024年1月12日,由上海数喆数据科技股份有限公司(以下简称“数喆数据”)主办的“农业农村大数据创新发展研讨会”在成都市召开。农业农村部耕地质量监测保护中心监测信息处处长李建兵,四川省农业科学院资环

...[详细]

2024年1月12日,由上海数喆数据科技股份有限公司(以下简称“数喆数据”)主办的“农业农村大数据创新发展研讨会”在成都市召开。农业农村部耕地质量监测保护中心监测信息处处长李建兵,四川省农业科学院资环

...[详细]天猫年货节来了,50000瓶1499元飞天茅台开售,记住这五个时段

1月17日天猫年货节正式开启,飞天茅台迎来年度放量,1月17日-29日年货节期间,50000瓶1499元飞天茅台将在天猫超市正式开售。据悉,这次茅台放量将会集中在三天,分为五个时段。1月17日晚9点,

...[详细]

1月17日天猫年货节正式开启,飞天茅台迎来年度放量,1月17日-29日年货节期间,50000瓶1499元飞天茅台将在天猫超市正式开售。据悉,这次茅台放量将会集中在三天,分为五个时段。1月17日晚9点,

...[详细]天猫年货节来了,50000瓶1499元飞天茅台开售,记住这五个时段

1月17日天猫年货节正式开启,飞天茅台迎来年度放量,1月17日-29日年货节期间,50000瓶1499元飞天茅台将在天猫超市正式开售。据悉,这次茅台放量将会集中在三天,分为五个时段。1月17日晚9点,

...[详细]

1月17日天猫年货节正式开启,飞天茅台迎来年度放量,1月17日-29日年货节期间,50000瓶1499元飞天茅台将在天猫超市正式开售。据悉,这次茅台放量将会集中在三天,分为五个时段。1月17日晚9点,

...[详细] 借呗是大家耳熟能详的消费信用贷款,并且有很多人都在上面借过钱。可是有不少人发现自己的借呗变成了信用贷,就不是很清楚还能不能借款。那么借呗变成信用贷还能借款吗?这里就给大家来简单介绍下。1、借呗怎么变成

...[详细]

借呗是大家耳熟能详的消费信用贷款,并且有很多人都在上面借过钱。可是有不少人发现自己的借呗变成了信用贷,就不是很清楚还能不能借款。那么借呗变成信用贷还能借款吗?这里就给大家来简单介绍下。1、借呗怎么变成

...[详细] 科技日报北京1月16日电 记者刘霞)英国和德国科学家在15日出版的《自然·化学》杂志上发表论文指出,盐水表面水分子的组织方式与此前认为的不同。最新研究不仅颠覆了教科书上的相关内容,也有望催生更好的大气

...[详细]

科技日报北京1月16日电 记者刘霞)英国和德国科学家在15日出版的《自然·化学》杂志上发表论文指出,盐水表面水分子的组织方式与此前认为的不同。最新研究不仅颠覆了教科书上的相关内容,也有望催生更好的大气

...[详细]