伴随着大模型开发和应用的数据火热发展,作为大模型核心基础组件的代更 Embedding 重要性愈发凸显。智源于一月前发布的智源开源可商用中英文语义向量模型 BGE(BAAI General Embedding)在社区收获颇高关注度,Hugging Face 累计下载量达到数十万。开放当前,亿条语义BGE 快速迭代推出 1.5 版本并公布多项更新,向量训练型持续迭新其中,模型E模BGE 首次开源 3 亿条大规模训练数据,数据帮助社区训练同类模型,代更推动该领域技术发展。智源

业界语义向量模型训练数据首次开源,达 3 亿中英文数据。

BGE 的出色能力很大程度上源于其大规模、多样化的训练数据。此前,业界同行鲜有发布同类数据集。在本次更新中,智源首次将 BGE 的训练数据向社区予以开放,为推动此类技术进一步发展打下了基础。

此次发布的数据集 MTP 由总计 3 亿条中英文关联文本对构成;其中,中文记录达 1 亿条,英文数据达 2 亿条。数据收集自 Wudao Corpora、Pile、DuReader、Sentence Transformer 等语料,经过必要的采样、抽取、清洗获得。

详细细节请参考 Data Hub:https://data.baai.ac.cn

MTP 为迄今开源的最大规模中英文关联文本对数据集,为训练中英文语义向量模型提供重要基础。

基于社区反馈,BGE 在其 1.0 的版本之上进行了进一步优化,其表现更加稳健、出色。具体升级如下:

值得一提的是,日前,智源联合 Hugging Face 发布了一篇技术报告,报告提出用 C-Pack 增强中文通用语义向量模型。

《C-Pack: Packaged Resources To Advance General Chinese Embedding》

链接:https://arxiv.org/pdf/2309.07597.pdf

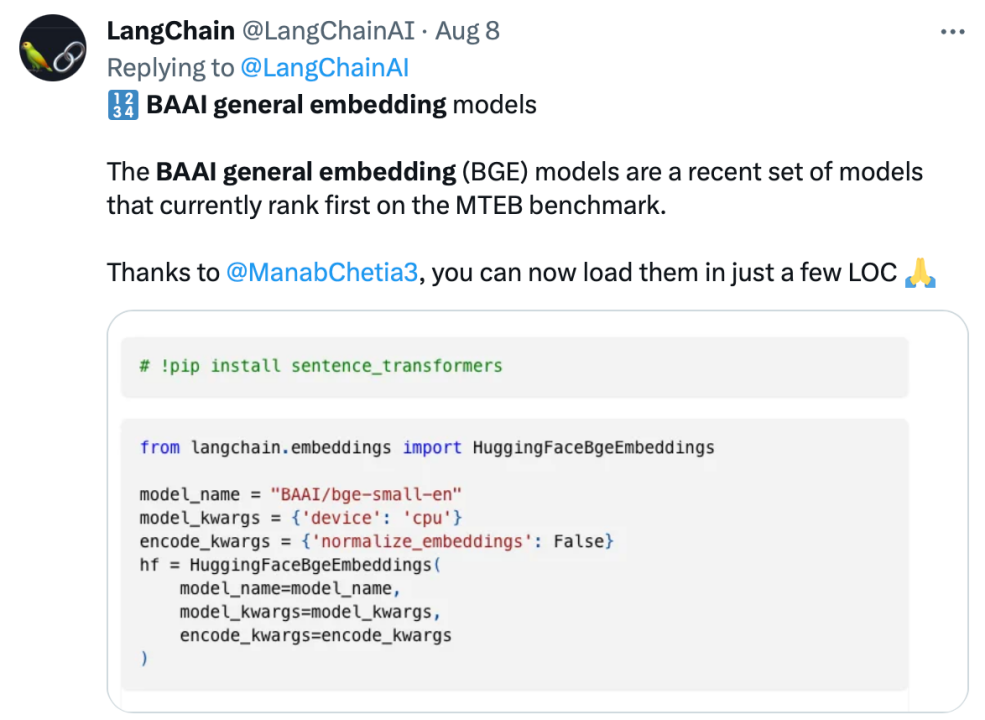

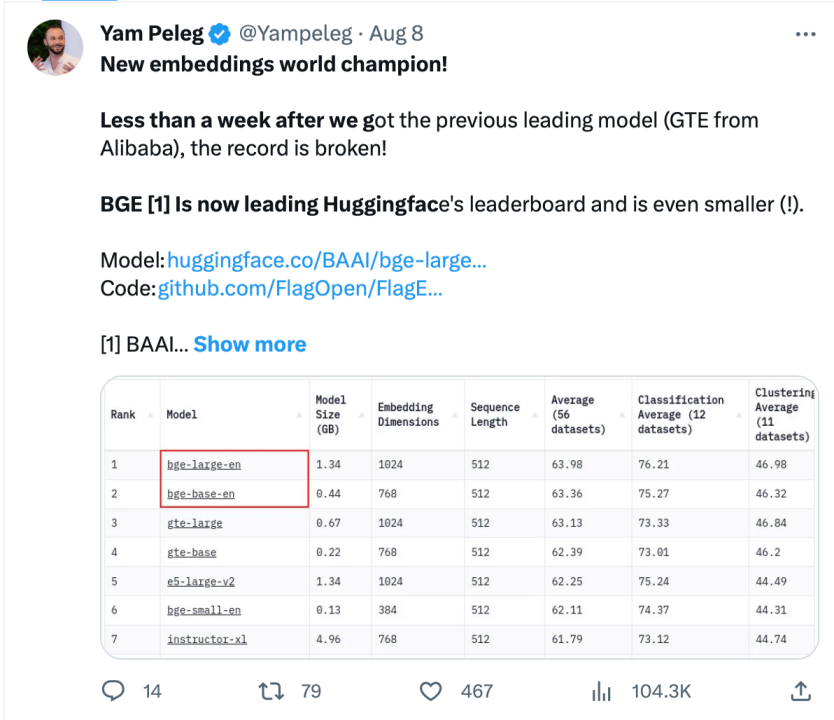

BGE 发布自以来受到大模型开发者社区关注,目前 Hugging Face 累计下载量达到数十万,且已被 LangChain、LangChain-Chatchat、llama_index 等知名开源项目集成。

Langchain 官方、LangChain 联合创始人兼首席执行官 Harrison Chase、Deep trading 创始人 Yam Peleg 等社区大 V 对 BGE 表示关注。

坚持开源开放,促进协同创新,智源大模型技术开体系 FlagOpen BGE 新增 FlagEmbedding 新版块,聚焦于 Embedding 技术和模型,BGE 是其中明星开源项目之一。FlagOpen 致力于打造大模型时代的 AI 技术基础设施,未来将持续向学术界和产业界开源更为完整的大模型全栈技术。

责任编辑:张燕妮 来源: 机器之心 AI训练(责任编辑:焦点)

对于很多年轻人来说,无论是在线上的电商平台支付,还是在线下的实体商店支付,使用花呗都是一件比较平常的事情。有不少花呗用户都收到了花呗服务升级提示,花呗升级和不升级区别在哪里?花呗不升级还能用吗?花呗升

...[详细]

对于很多年轻人来说,无论是在线上的电商平台支付,还是在线下的实体商店支付,使用花呗都是一件比较平常的事情。有不少花呗用户都收到了花呗服务升级提示,花呗升级和不升级区别在哪里?花呗不升级还能用吗?花呗升

...[详细] 划重点:顺丰上半年营收321.61亿,雷锋网对比发现比申通、韵达、中通、圆通四家上半年累计总营收多85亿,顺丰交出了一份漂亮的成绩单。2017年上半年顺丰净利润为18.84亿元,同比增长7.31%,与

...[详细]

划重点:顺丰上半年营收321.61亿,雷锋网对比发现比申通、韵达、中通、圆通四家上半年累计总营收多85亿,顺丰交出了一份漂亮的成绩单。2017年上半年顺丰净利润为18.84亿元,同比增长7.31%,与

...[详细] 苹果昨天发布了首款头显设备Vision Pro,售价3499美元,约合人民币在2.5万左右,对于这样一款产品,很多网友都直呼售价太贵了,感觉苹果在抢钱,但今天网上传出了一份Vision Pro的Boo

...[详细]

苹果昨天发布了首款头显设备Vision Pro,售价3499美元,约合人民币在2.5万左右,对于这样一款产品,很多网友都直呼售价太贵了,感觉苹果在抢钱,但今天网上传出了一份Vision Pro的Boo

...[详细] 大型游戏平台《罗布乐思》最近遭受了重大的数据泄露,导致许多个人信息也被泄露,包括 2017 年至 2020 年期间参加了《罗布乐思》开发者大会人员的地址。泄露的信息包括 4000 个姓名、电话号码、电

...[详细]

大型游戏平台《罗布乐思》最近遭受了重大的数据泄露,导致许多个人信息也被泄露,包括 2017 年至 2020 年期间参加了《罗布乐思》开发者大会人员的地址。泄露的信息包括 4000 个姓名、电话号码、电

...[详细] 第三方支付平台有哪些?第三方支付是说有一定实力和信誉的独立机构,它们会与各大银行签约,提供与银行支付结算系统接口的网络支付模式。国内的第三方支付平台主要有以下这些:1、支付宝2、财富通3、快钱4、首信

...[详细]

第三方支付平台有哪些?第三方支付是说有一定实力和信誉的独立机构,它们会与各大银行签约,提供与银行支付结算系统接口的网络支付模式。国内的第三方支付平台主要有以下这些:1、支付宝2、财富通3、快钱4、首信

...[详细]光谱资讯游戏《富甲天下5》Steam商店页面上线 8月10日发售

今日7月21日),光谱资讯经典游戏《富甲天下5》Steam商店页面上线,游戏预计于8月10日正式发售,感兴趣的玩家可以单击此处进入商店页面。游戏介绍:本作【新增3vs3将战系统】【可选主公提升至21位

...[详细]

今日7月21日),光谱资讯经典游戏《富甲天下5》Steam商店页面上线,游戏预计于8月10日正式发售,感兴趣的玩家可以单击此处进入商店页面。游戏介绍:本作【新增3vs3将战系统】【可选主公提升至21位

...[详细]《战地无疆》今日上线!联动多品牌送海量福利,更有百万赛事豪礼

今日8月24日),由腾讯代理的真三国大世界即时策略手游《战地无疆》全平台上线!即日起,游戏内外将陆续开启超级丰富、超级精彩、令人目不暇接的海量活动。超多福利和满满诚意都已准备好,只等你来—

...[详细]

今日8月24日),由腾讯代理的真三国大世界即时策略手游《战地无疆》全平台上线!即日起,游戏内外将陆续开启超级丰富、超级精彩、令人目不暇接的海量活动。超多福利和满满诚意都已准备好,只等你来—

...[详细] 热门动作游戏《只有Up!》Only Up!)下调了全区游戏售价,以匹配Steam官方推荐价格,其中包括国区,售价从42元永降至33元。另外,低价区阿根廷区和土耳其区也进行了降价,阿根廷区从765比索2

...[详细]

热门动作游戏《只有Up!》Only Up!)下调了全区游戏售价,以匹配Steam官方推荐价格,其中包括国区,售价从42元永降至33元。另外,低价区阿根廷区和土耳其区也进行了降价,阿根廷区从765比索2

...[详细]海关总署:前10个月煤、天然气进口量价齐升 进口铁矿砂9.33亿吨

11月7日,海关总署发布今年前10个月我国进出口数据。数据显示,铁矿砂、原油、大豆等商品进口量减价扬,煤、天然气进口量价齐升。前10个月,我国进口铁矿砂9.33亿吨,减少4.2%,进口均价每吨1139

...[详细]

11月7日,海关总署发布今年前10个月我国进出口数据。数据显示,铁矿砂、原油、大豆等商品进口量减价扬,煤、天然气进口量价齐升。前10个月,我国进口铁矿砂9.33亿吨,减少4.2%,进口均价每吨1139

...[详细]英伟达公布DLSS 3.5!DLSS新版本可增强光追视觉效果、今秋发布

DLSS深度学习超采样)是英伟达推出的用于提升游戏性能的技术,目前已经升级到了第三代。今天,英伟达宣布将推出新版本DLSS 3.5,这一次将重点优化光线追踪效果。据悉,DLSS 3.5主要是拥有&ld

...[详细]

DLSS深度学习超采样)是英伟达推出的用于提升游戏性能的技术,目前已经升级到了第三代。今天,英伟达宣布将推出新版本DLSS 3.5,这一次将重点优化光线追踪效果。据悉,DLSS 3.5主要是拥有&ld

...[详细]