基于Ampere架构的英伟A100系列计算卡在过去三年里被众多高性能计算集群(HPC)所采用,英伟达在去年推出了新一代基于Hopper架构的达正H100系列计算卡,进一步提高了算力,为中这些GPU大量用于人工智能和深度学习任务。国区共由于众所周知的开发款原因,英伟达为了绕开去年施加的新款芯片相关出口限制,先后推出了A800系列和H800系列计算卡专供中国市场使用。特供与原有的英伟A100/H100系列相比,A800/H800系列的达正规格基本相同,比较大的为中区别在于NVLink互连总线的连接速率。

随着近期新一轮更加严格的国区共管控措施,A800/H800系列计算卡也逃脱不了限制,开发款甚至连消费端的新款芯片GeForce RTX 4090游戏显卡也受到了影响。据《科创板日报》的特供报道,从产业链人士处了解到,英伟英伟达故技重施,正在开发针对中国区的最新改良版芯片,包括了HGX H20、L20 PCle和L2 PCle三款产品。

据了解,HGX H20、L20 PCle和L2 PCle都是基于H100计算卡改造而来,英伟达最快会在本月16号之后公布相关信息,而国内的厂商最快会在未来几天拿到对应的产品。目前《科创板日报》已向英伟达求证该消息的真实性,但截至发稿为止,英伟达暂时还没有回应。

H100所搭载的是GH100芯片,其完整的芯片配置了8组GPC、72组TPC、144组SM、共18432个FP32 CUDA核心。其采用了第四代Tensor Core,共576个,并配有60MB的L2缓存。有不过实际产品中没有全部打开,其中SXM5版本中启用了132组SM,共16896个FP32 CUDA核心,528个Tensor Core以及50MB的L2缓存,而PCIe 5.0版本则启用了114组SM,FP32 CUDA核心数量只有14592个。此外,前者的TDP达到了700W,后者则为350W。

此外,H100支持英伟达第四代NVLink接口,可提供高达900 GB/s的带宽。同时H100是第一款支持PCIe 5.0标准的GPU,也是第一款采用HBM3的GPU,最多支持六颗HBM3,带宽为3TB/s,是A100采用HBM2E的1.5倍,默认显存容量为80GB。

(责任编辑:焦点)

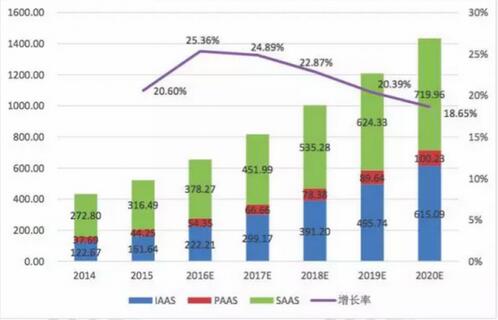

2022年全球人工智能软件市场规模将达625亿美元 相比2021年增长21.3%

11月30日,据市场机构Gartner预测,2022年全球人工智能(AI)软件收入总额预计将达625亿美元,相比2021年增长21.3%。Gartner认为,2022年人工智能软件支出的前五个用例类别

...[详细]

11月30日,据市场机构Gartner预测,2022年全球人工智能(AI)软件收入总额预计将达625亿美元,相比2021年增长21.3%。Gartner认为,2022年人工智能软件支出的前五个用例类别

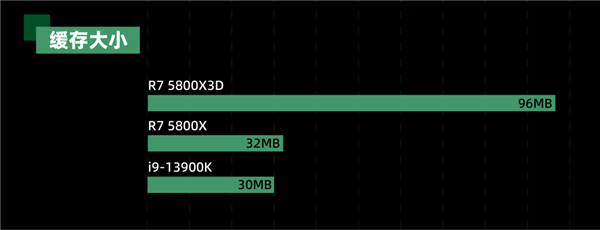

...[详细]苏妈的反击!探寻地表游戏CPU锐龙9 7950X3D:帧数太离谱了

苏妈的反击!探寻地表游戏CPU锐龙9 7950X3D:帧数太离谱了作者:托尼 2023-02-28 07:33:18商务办公 假如你现在正好还没配电脑,那我觉得这次的 7950X3D 真的可以冲 ——

...[详细]

苏妈的反击!探寻地表游戏CPU锐龙9 7950X3D:帧数太离谱了作者:托尼 2023-02-28 07:33:18商务办公 假如你现在正好还没配电脑,那我觉得这次的 7950X3D 真的可以冲 ——

...[详细] 昨日,针对搜房CEO李忠近日在《致北大同学李彦宏的一封公开信》中对百度品牌专区忽略商标权的质疑,百度在其官方微信发布《回搜房李忠先生书》作出回应。百度回应表示,百度品牌专区的归属取决于商标权的归属,而

...[详细]

昨日,针对搜房CEO李忠近日在《致北大同学李彦宏的一封公开信》中对百度品牌专区忽略商标权的质疑,百度在其官方微信发布《回搜房李忠先生书》作出回应。百度回应表示,百度品牌专区的归属取决于商标权的归属,而

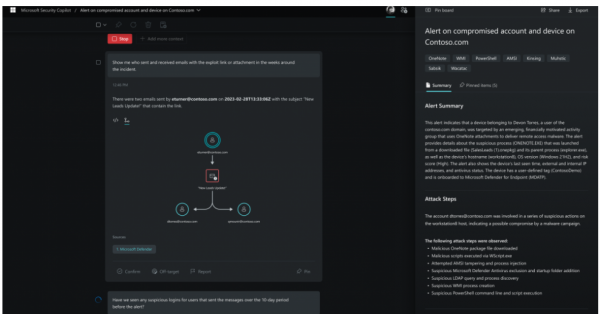

...[详细]微软推出AI工具Security Copilot,帮助网络安全人员应对威胁

微软推出AI工具Security Copilot,帮助网络安全人员应对威胁作者:微软 2023-03-29 14:32:59安全 应用安全 人工智能 近日微软推出了Security Copilot,这

...[详细]

微软推出AI工具Security Copilot,帮助网络安全人员应对威胁作者:微软 2023-03-29 14:32:59安全 应用安全 人工智能 近日微软推出了Security Copilot,这

...[详细] 农行银行卡默认开通小额免密免签支付功能,虽然平时消费方便,但也存在安全隐患,那么在农行掌上银行上要怎么关闭小额免密支付功能呢?农行掌上银行怎么关闭小额免密支付?【1】首先在手机上打开并登录农业银行Ap

...[详细]

农行银行卡默认开通小额免密免签支付功能,虽然平时消费方便,但也存在安全隐患,那么在农行掌上银行上要怎么关闭小额免密支付功能呢?农行掌上银行怎么关闭小额免密支付?【1】首先在手机上打开并登录农业银行Ap

...[详细] 始自1957年,旨在表彰世界各种精品设计的《日本设计大奖》官方日前公布了部分获奖名单,其中微软的Xbox Series X|S以及自适应手柄获得了金奖,并进入了最终大奖的候选。•《日本设计大奖》是日本

...[详细]

始自1957年,旨在表彰世界各种精品设计的《日本设计大奖》官方日前公布了部分获奖名单,其中微软的Xbox Series X|S以及自适应手柄获得了金奖,并进入了最终大奖的候选。•《日本设计大奖》是日本

...[详细]《无人深空》4.0更新“Waypoint”上线 Switch版正式发售

《无人深空》4.0更新现已跟随Switch版游戏一同上线,4.0更新被称为“Waypoint”,除了主要适配Switch主机外,该更新为玩家带来了大量生活质量改进,包括新辅助功能、难度选项、更新后的视

...[详细]

《无人深空》4.0更新现已跟随Switch版游戏一同上线,4.0更新被称为“Waypoint”,除了主要适配Switch主机外,该更新为玩家带来了大量生活质量改进,包括新辅助功能、难度选项、更新后的视

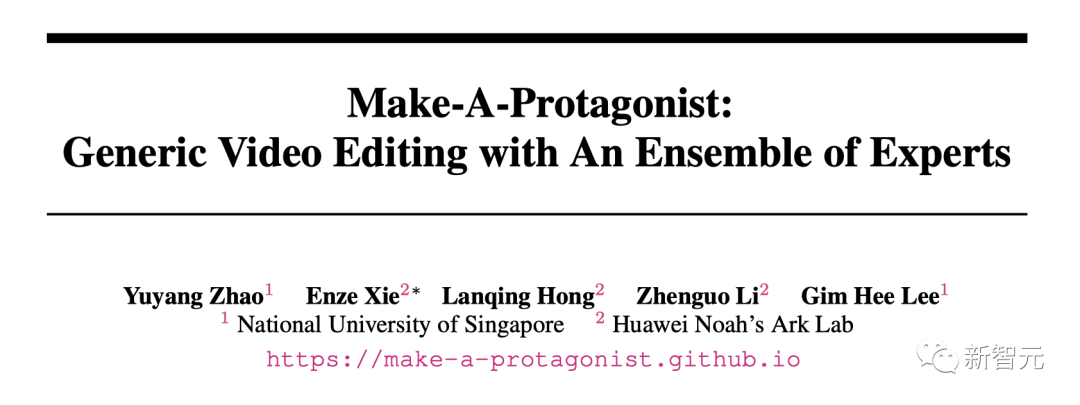

...[详细]无需微调,一张照片即可换脸、换背景!NUS等华人团队破局个性化视频生成

无需微调,一张照片即可换脸、换背景!NUS等华人团队破局个性化视频生成作者:新智元 2023-05-26 00:19:07开发 项目管理 只要一张参考图片,任何人都可以替换成视频的主角。 随着扩散模型

...[详细]

无需微调,一张照片即可换脸、换背景!NUS等华人团队破局个性化视频生成作者:新智元 2023-05-26 00:19:07开发 项目管理 只要一张参考图片,任何人都可以替换成视频的主角。 随着扩散模型

...[详细] 4月22日,从中国五矿获悉,一季度,中国五矿营收同比增长11.9%,创历史同期最高;利润、净利润双双大幅超出预期,运行效率整体显著改善。一季度,中国五矿金属矿业利润总额同比增长23%,冶金建设营收同比

...[详细]

4月22日,从中国五矿获悉,一季度,中国五矿营收同比增长11.9%,创历史同期最高;利润、净利润双双大幅超出预期,运行效率整体显著改善。一季度,中国五矿金属矿业利润总额同比增长23%,冶金建设营收同比

...[详细]Kotlin 1.8 将彻底移除 Kotlin Synthetics

Kotlin 1.8 将彻底移除 Kotlin Synthetics作者:Alias_Travis 2022-02-28 10:38:13移动开发 Android 虽然 Synthetic 具备不错的

...[详细]

Kotlin 1.8 将彻底移除 Kotlin Synthetics作者:Alias_Travis 2022-02-28 10:38:13移动开发 Android 虽然 Synthetic 具备不错的

...[详细]