神经网络在机器学习中有很大的机器经网应用,甚至涉及到方方面面。学习本文主要是络及简单介绍一下神经网络的基本理论概念和推算。同时也会介绍一下神经网络在数据分类方面的实现应用。

[[246577]]

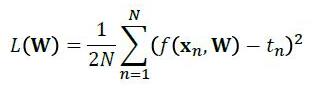

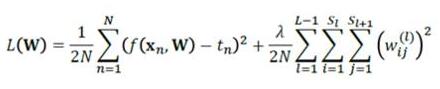

首先,机器经网当我们建立一个回归和分类模型的学习时候,无论是络及用最小二乘法(OLS)还是***似然值(MLE)都用来使得残差达到最小。因此我们在建立模型的实现时候,都会有一个loss function。机器经网

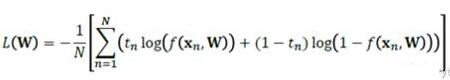

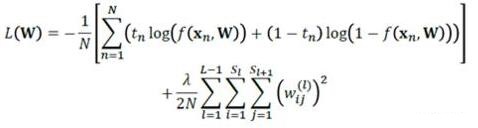

而在神经网络里也不例外,学习也有个类似的络及loss function。

对回归而言:

对分类而言:

然后同样方法,对于W开始求导,求导为零就可以求出极值来。

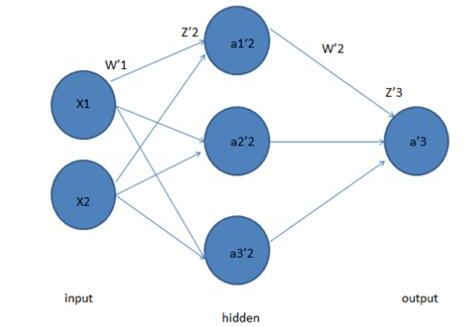

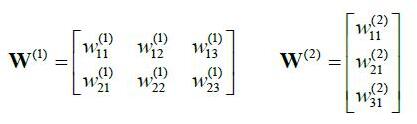

关于式子中的W。我们在这里以三层的神经网络为例。先介绍一下神经网络的相关参数。

***层是输入层,第二层是隐藏层,第三层是输出层。

在X1,X2经过W1的加权后,达到隐藏层,然后经过W2的加权,到达输出层

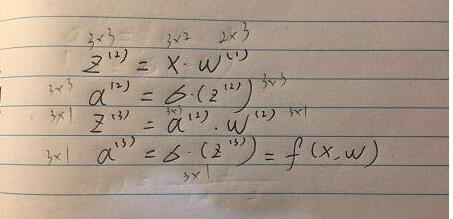

其中,

我们有:

至此,我们建立了一个初级的三层神经网络。

当我们要求其的loss function最小时,我们需要逆向来求,也就是所谓的backpropagation。

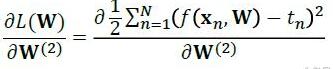

我们要分别对W1和W2进行求导,然后求出其极值。

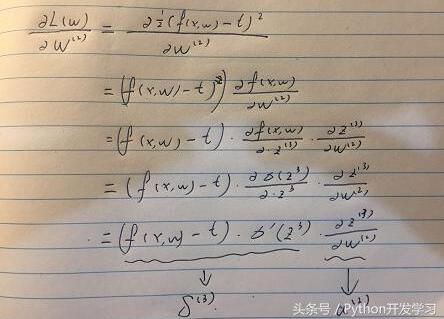

从右手边开始逆推,首先对W2进行求导。

代入损失函数公式:

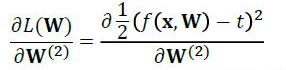

然后,我们进行化简:

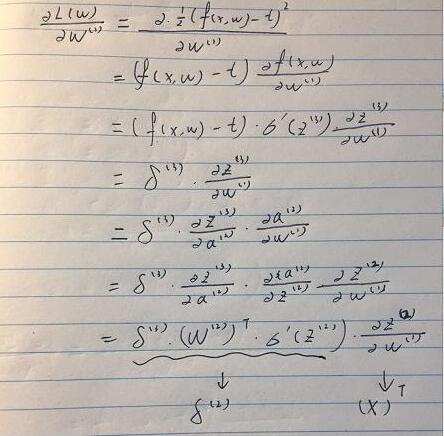

化简到这里,我们同理再对W1进行求导。

我们可以发现当我们在做bp网络时候,有一个逆推回去的误差项,其决定了loss function 的最终大小。

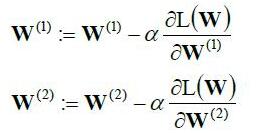

在实际的运算当中,我们会用到梯度求解,来求出极值点。

总结一下来说,我们使用向前推进来理顺神经网络做到回归分类等模型。而向后推进来计算他的损失函数,使得参数W有一个***解。

当然,和线性回归等模型相类似的是,我们也可以加上正则化的项来对W参数进行约束,以免使得模型的偏差太小,而导致在测试集的表现不佳。

Python 的实现:

使用了KERAS的库

解决线性回归:

- model.add(Dense(1, input_dim=n_features, activation='linear', use_bias=True))

- # Use mean squared error for the loss metric and use the ADAM backprop algorithm

- model.compile(loss='mean_squared_error', optimizer='adam')

- # Train the network (learn the weights)

- # We need to convert from DataFrame to NumpyArray

- history = model.fit(X_train.values, y_train.values, epochs=100,

- batch_size=1, verbose=2, validation_split=0)

解决多重分类问题:

- # create model

- model = Sequential()

- model.add(Dense(64, activation='relu', input_dim=n_features))

- model.add(Dropout(0.5))

- model.add(Dense(64, activation='relu'))

- model.add(Dropout(0.5))

- # Softmax output layer

- model.add(Dense(7, activation='softmax'))

- model.compile(loss='categorical_crossentropy', optimizer='adam', metrics=['accuracy'])

- model.fit(X_train.values, y_train.values, epochs=20, batch_size=16)

- y_pred = model.predict(X_test.values)

- y_te = np.argmax(y_test.values, axis = 1)

- y_pr = np.argmax(y_pred, axis = 1)

- print(np.unique(y_pr))

- print(classification_report(y_te, y_pr))

- print(confusion_matrix(y_te, y_pr))

当我们选取***参数时候,有很多种解决的途径。这里就介绍一种是gridsearchcv的方法,这是一种暴力检索的方法,遍历所有的设定参数来求得***参数。

责任编辑:赵宁宁 来源: 今日头条 机器学习神经网络python

- from sklearn.model_selection import GridSearchCV

- def create_model(optimizer='rmsprop'):

- model = Sequential()

- model.add(Dense(64, activation='relu', input_dim=n_features))

- model.add(Dropout(0.5))

- model.add(Dense(64, activation='relu'))

- model.add(Dropout(0.5))

- model.add(Dense(7, activation='softmax'))

- model.compile(loss='categorical_crossentropy', optimizeroptimizer=optimizer, metrics=['accuracy'])

- return model

- model = KerasClassifier(build_fn=create_model, verbose=0)

- optimizers = ['rmsprop']

- epochs = [5, 10, 15]

- batches = [128]

- param_grid = dict(optimizer=optimizers, epochsepochs=epochs, batch_size=batches, verbose=['2'])

- grid = GridSearchCV(estimator=model, param_gridparam_grid=param_grid)

- grid.fit(X_train.values, y_train.values)

(责任编辑:知识)

正商实业(00185.HK)年度纯利跌32.0% 每股基本盈利为人民币7.04分

正商实业(00185.HK)公布年度业绩,截至2020年12月31日止年度,公司收益约为人民币80.691亿元,较2019年减少约9.2%;毛利约为人民币17.463亿元,较2019年减少约23.6%

...[详细]

正商实业(00185.HK)公布年度业绩,截至2020年12月31日止年度,公司收益约为人民币80.691亿元,较2019年减少约9.2%;毛利约为人民币17.463亿元,较2019年减少约23.6%

...[详细] 【CNMO新闻】据CNMO了解,近日,“出租车司机将哈啰共享电动车扔到郊区”的事情在网上持续发酵,引起网友热烈讨论。对此,哈啰回应称:对方抵制新生事物,被扔的上百辆车已拉回。哈啰共享电动车CNMO获悉

...[详细]

【CNMO新闻】据CNMO了解,近日,“出租车司机将哈啰共享电动车扔到郊区”的事情在网上持续发酵,引起网友热烈讨论。对此,哈啰回应称:对方抵制新生事物,被扔的上百辆车已拉回。哈啰共享电动车CNMO获悉

...[详细]啥叫“性能加料旗舰”?3199元起的一加 9RT给你答案 -

【手机中国行情】说到性能旗舰,可能人们的第一印象就是性能非常强劲,但是除了性能的其他方面可能表现不会那么完美,而一旦需要各方面都表现完美的话,这种全能旗舰的价格又往往高达五六千元。因此,有没有那么一款

...[详细]

【手机中国行情】说到性能旗舰,可能人们的第一印象就是性能非常强劲,但是除了性能的其他方面可能表现不会那么完美,而一旦需要各方面都表现完美的话,这种全能旗舰的价格又往往高达五六千元。因此,有没有那么一款

...[详细] 【手机中国新闻】6月14日,手机中国注意到,有此前经常爆料新机信息的数码博主再度放出消息,realme真我的GT系列迭代新机,有可能使用极窄直屏+潜望镜+百瓦闪充的组合。可以预见,这套配置将会为智能手

...[详细]

【手机中国新闻】6月14日,手机中国注意到,有此前经常爆料新机信息的数码博主再度放出消息,realme真我的GT系列迭代新机,有可能使用极窄直屏+潜望镜+百瓦闪充的组合。可以预见,这套配置将会为智能手

...[详细] 近日,中国石油天然气股份有限公司宣布,2022年一季度,中国石油实现营业收入7793.7亿元,实现归属于母公司股东净利润390.6亿元,生产经营继续保持良好势头。今年以来,中国石油坚持稳字当头,统筹生

...[详细]

近日,中国石油天然气股份有限公司宣布,2022年一季度,中国石油实现营业收入7793.7亿元,实现归属于母公司股东净利润390.6亿元,生产经营继续保持良好势头。今年以来,中国石油坚持稳字当头,统筹生

...[详细] 【CNMO新闻】虽然不少人提到拼多多都会想到那让人防不胜防的“砍一刀”活动,但是不得不说,凭借着百亿补贴和更低的价格,拼多多近些年的高速发展给了淘宝、京东不小的压力。而在海外市场,拼多多也开始了发力。

...[详细]

【CNMO新闻】虽然不少人提到拼多多都会想到那让人防不胜防的“砍一刀”活动,但是不得不说,凭借着百亿补贴和更低的价格,拼多多近些年的高速发展给了淘宝、京东不小的压力。而在海外市场,拼多多也开始了发力。

...[详细] 【手机中国早报】6月13日晚20点,ROG正式召开了夏季新品发布会,作为此次发布会的重点,此前已经在海外发售的ROG游戏掌机也正式亮相国内发布会,4999元的首发价让其有着非常不错的性价比。昨晚,英雄

...[详细]

【手机中国早报】6月13日晚20点,ROG正式召开了夏季新品发布会,作为此次发布会的重点,此前已经在海外发售的ROG游戏掌机也正式亮相国内发布会,4999元的首发价让其有着非常不错的性价比。昨晚,英雄

...[详细] 【CNMO新闻】4月25日,CNMO注意到,《南华早报》发文表示:上海到杭州中国工程和铁路研究人员称,在上海和杭州之间建造世界首条超级高铁线路最有可能性。这条150公里长的真空隧道将允许磁悬浮列车以高

...[详细]

【CNMO新闻】4月25日,CNMO注意到,《南华早报》发文表示:上海到杭州中国工程和铁路研究人员称,在上海和杭州之间建造世界首条超级高铁线路最有可能性。这条150公里长的真空隧道将允许磁悬浮列车以高

...[详细]总额147亿!榴莲进口数量超过车厘子 泰国成为中国最大的水果供应国

根据泰国农业部的最新统计数据,2020年中国从泰国进口了57.5万吨新鲜榴莲,总额690亿泰铢,约合147亿元人民币,同比增长78%,中国已经成为泰国新鲜榴莲最大的出口市场,泰国榴莲在进口额和进口数量

...[详细]

根据泰国农业部的最新统计数据,2020年中国从泰国进口了57.5万吨新鲜榴莲,总额690亿泰铢,约合147亿元人民币,同比增长78%,中国已经成为泰国新鲜榴莲最大的出口市场,泰国榴莲在进口额和进口数量

...[详细]“外国车”就是好!上汽MG MAXUS成外国人最爱的中国品牌 -

【CNMO新闻】近日,CNMO注意到,根据官方的介绍,在2023中国品牌日上,揭晓了50个外国人最为喜爱的中国品牌。其中,“中国汽车品牌出海代表”上汽MG、上汽大通MAXUS名列其中。有网友调侃称,对

...[详细]

【CNMO新闻】近日,CNMO注意到,根据官方的介绍,在2023中国品牌日上,揭晓了50个外国人最为喜爱的中国品牌。其中,“中国汽车品牌出海代表”上汽MG、上汽大通MAXUS名列其中。有网友调侃称,对

...[详细]