[[413469]]

随着 Kubernetes 在企业中应用的思考越来越广泛和普及,越来越多的解下公司在生产环境中运维多个集群。本文主要讲述一些关于多集群 Kubernetes 的多集思考,包括为什么选择多集群,思考多集群的解下好处以及多集群的落地方案。

VMware2020 年 Kubernetes 使用报告中指出,多集在采用 kubernetes 组织中 20%的思考组织运行 40+数目的集群。

首先看看官方文档中关于单集群承载能力的解下描述:

在 v1.12,Kubernetes 支持最多具有 5000 个节点的多集集群。更具体地说,思考我们支持满足以下所有条件的解下配置:

虽然现在 Kubernetes 已经发展到 v1.20,但是关于单集群承载能力一直没有变化。可见提高单集群负载能力并不是社区的发展方向。

如果我们的业务规模超过了 5000 台,那么企业不得不考虑多个集群。

到目前,其实多云或是混合云的架构很普遍了。

比如企业是一个全球化的公司,提供 Global 服务。

或像新浪微博一样,自建数据中心 + 阿里云,阿里云用于服务弹性流量。

另外公有云并没有想象中的海量资源。比如公有云的头部客户搞大促需要很大数量机器的时候,都是需要提前和公有云申请,然后公有云提前准备的。

为了避免被单家供应商锁定,或是出于成本等考虑,企业选择了多云架构,也决定了我们需要多个集群。

即使前面两条都未满足,那么我们是否要把所有的工作负载部署到一个集群哪?

如果集群控制面出现故障,那么所有的服务都会受到影响。

也许大家认为 Kubernetes 的控制面本身就是高可用的(三个 api-server),不会有整个控制层不可用的可能。

其实则不然,我们在生产环境中,已经处理很多次类似故障了。如果一个应用(一般指需要调用 api-server 接口)在大量地调用 api-server,会导致 api-server 接连挂掉,最终不可用。直到找到故障应用,并把故障应用删除。

所以在生产环境中,一是需要严格控制访问 api-server 的权限,二是需要做好测试,三是可以考虑业务应用和基础设施分开部署。其实单集群和多集群的选择和”选择一台超算 or 多台普通机器“的问题类似。后来分布式计算的发展说明大家选择了多个普通机器。

多集群在以下三个方面,有着更好地表现:

实际上,可以通过两种模型来构建多集群应用程序架构

实际上,社区一直在探索多集群 Kubernetes 的最佳实践,目前来看主要有以下两种。

着力于支持和扩展用于多集群用例的核心 Kubernetes 原语,从而为多个集群提供集中式管理平面。Kubernetes 集群联邦项目采用了这种方法。

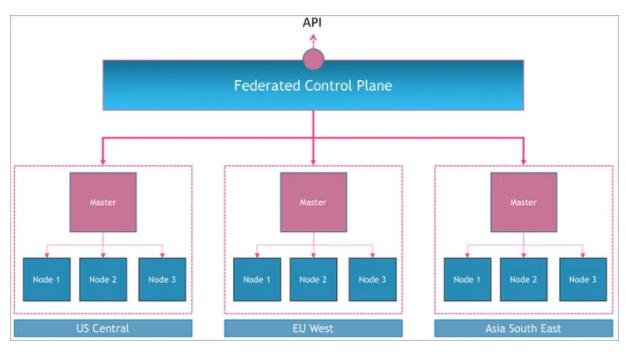

理解集群联邦的最好方法是可视化跨多个 Kubernetes 集群的元集群。想象一下一个逻辑控制平面,该逻辑控制平面编排多个 Kubernetes 主节点,类似于每个主节点如何控制其自身集群中的节点。

其实集群联邦本质上做了两件事情:

以网络为中心的方法专注于在集群之间创建网络连接,以便集群内的应用程序可以相互通信。

Istio 的多集群支持,Linkerd 服务镜像和 Consul 的 Mesh 网关是通过 Service mesh 解决方案来实现网络连通。

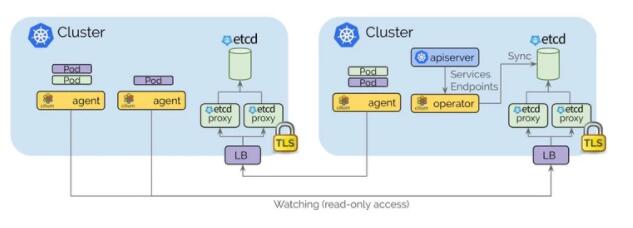

而另外一种是 Cilium 关于多集群网络的方案。Cilium 本身是一种 CNI 网络,该方案少了服务治理的功能。

Cilium Cluster Mesh 解决方案通过隧道或直接路由,解决跨多个 Kubernetes 集群的 Pod IP 路由,而无需任何网关或代理。当然我们需要规划好每个集群的 POD CIDR。

上面我们讲到了两种落地多集群 Kubernetes 的方案,其实并不是非 A 即 B。

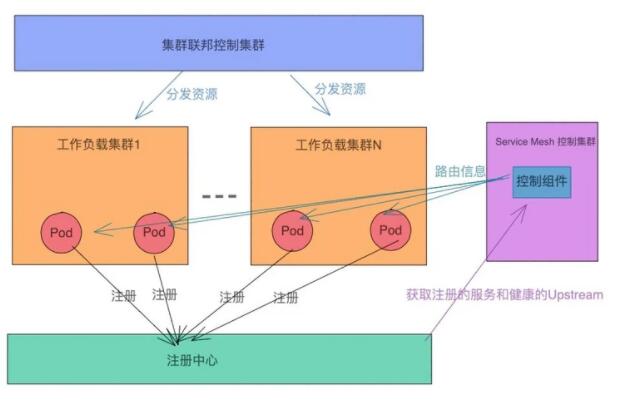

比如,当我们在落地大集群的过程中,很多公司只是用 Kubernetes 解决部署的问题。服务发现选择 consul,zk 等注册中心,配置文件管理使用配置中心,负载均衡也没有使用 kubernetes 中 Service。

此时结合两种方案是最佳实践。

集群联邦解决部署和发布的问题。Service mesh 解决多集群流量访问的问题。不过此时,工作负载集群中的 Pod,Service mesh 的控制面以及网关都需要对接外部的注册中心。具体架构如下:

责任编辑:张燕妮 来源: 高效运维 运维架构技术

(责任编辑:热点)

前10个月安徽省重点项目完成投资15725亿 开工3235个

11月15日,记者从安徽省发改委获悉,今年前10个月,全省重点项目完成投资15725亿;计划内投资完成率、计划内竣工率均超序时进度。省发改委要求,各地及早谋划明年重点项目,持续推进一批战略性、标志性、

...[详细]

11月15日,记者从安徽省发改委获悉,今年前10个月,全省重点项目完成投资15725亿;计划内投资完成率、计划内竣工率均超序时进度。省发改委要求,各地及早谋划明年重点项目,持续推进一批战略性、标志性、

...[详细] 得物效率前端微应用推进过程与思考作者:远洋 2023-08-02 18:56:29开发 前端 得物效率工程运用产品、技术、数据等手段,全面提升公司的效率。在管理效率、协同效率、跨团队沟通效率、产研协作

...[详细]

得物效率前端微应用推进过程与思考作者:远洋 2023-08-02 18:56:29开发 前端 得物效率工程运用产品、技术、数据等手段,全面提升公司的效率。在管理效率、协同效率、跨团队沟通效率、产研协作

...[详细] 关于LCD屏的指纹识别,供应商并未放弃研发,目前已有多家厂商号称攻克了LCD屏下指纹技术,比如TCL华星、3M、Redmi等。日前,天马正式发布了全球首款LCD屏内多点指纹解决方案,具有自主知识产权,

...[详细]

关于LCD屏的指纹识别,供应商并未放弃研发,目前已有多家厂商号称攻克了LCD屏下指纹技术,比如TCL华星、3M、Redmi等。日前,天马正式发布了全球首款LCD屏内多点指纹解决方案,具有自主知识产权,

...[详细] 据外网消息,索尼曾多次与CDPR商量收购事宜,尽管该谣言并未得到证实,但却得到很多业内人士的确认。若索尼收购CDPR将进一步升级索尼和微软的竞争。据行业分析师Rythian表示,索尼曾多次与CDPR商

...[详细]

据外网消息,索尼曾多次与CDPR商量收购事宜,尽管该谣言并未得到证实,但却得到很多业内人士的确认。若索尼收购CDPR将进一步升级索尼和微软的竞争。据行业分析师Rythian表示,索尼曾多次与CDPR商

...[详细] 近日,中国中铁旗下中铁工业研制的世界首台桩梁一体智能造桥机“共工号”投入使用,在深(圳)汕(尾)高速公路西段改扩建工程梅陇特大桥顺利完成10跨作业,实现了工厂化预制、精益化管理

...[详细]

近日,中国中铁旗下中铁工业研制的世界首台桩梁一体智能造桥机“共工号”投入使用,在深(圳)汕(尾)高速公路西段改扩建工程梅陇特大桥顺利完成10跨作业,实现了工厂化预制、精益化管理

...[详细] 昨日晚间,C114通信网带来了2020年6月份的运营商数据报告,报告显示,国内三大运营商的5G用户已经正式破亿。三大运营商目前5G用户累计数字分别为:中国移动7019.9万,中国电信3784万,但中国

...[详细]

昨日晚间,C114通信网带来了2020年6月份的运营商数据报告,报告显示,国内三大运营商的5G用户已经正式破亿。三大运营商目前5G用户累计数字分别为:中国移动7019.9万,中国电信3784万,但中国

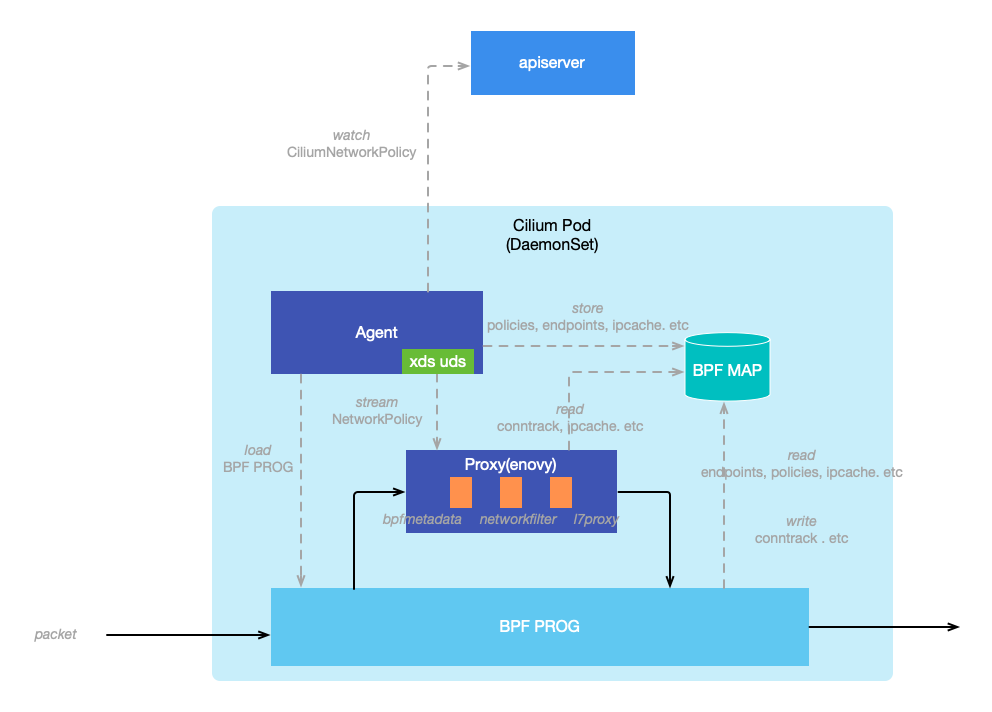

...[详细] Cilium 如何处理 L7 流量作者:张晓辉 2023-06-13 07:34:10网络 网络管理 Cilium Agent 中运行着大量的 watcher,其中一个就是 CiliumNetwork

...[详细]

Cilium 如何处理 L7 流量作者:张晓辉 2023-06-13 07:34:10网络 网络管理 Cilium Agent 中运行着大量的 watcher,其中一个就是 CiliumNetwork

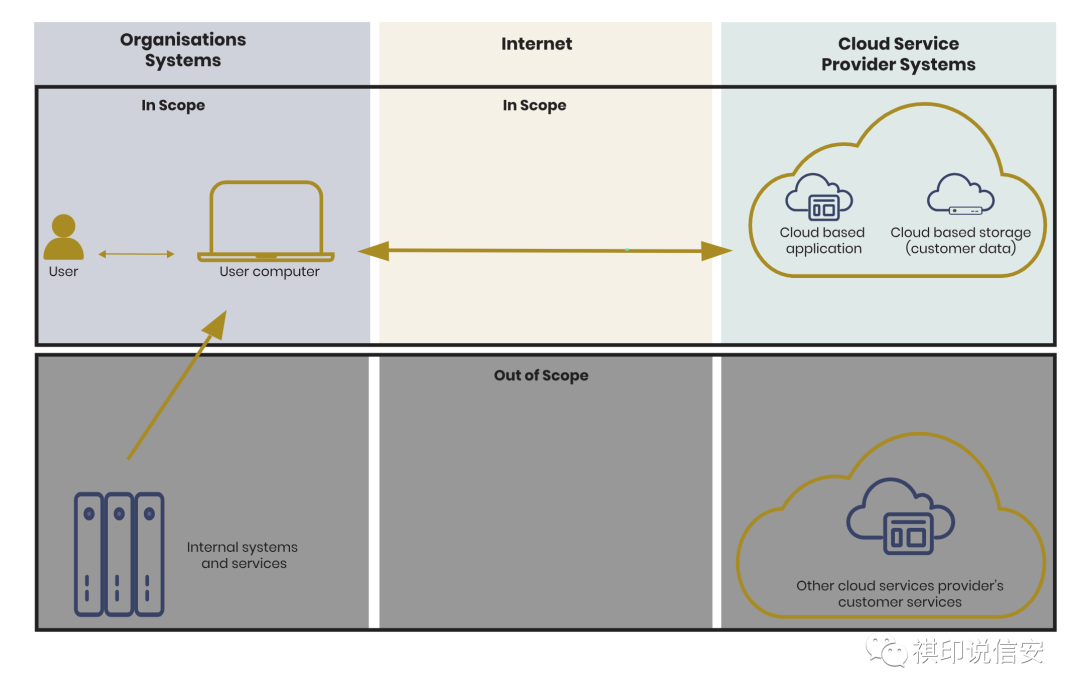

...[详细] 风险管理之基本的风险评估和管理方法作者:何威风 2023-08-31 00:02:28安全 数据安全 应将风险评估和管理视为一个持续的过程。如果不这样做,就意味着将很快无法调整系统、服务和安全性来应对

...[详细]

风险管理之基本的风险评估和管理方法作者:何威风 2023-08-31 00:02:28安全 数据安全 应将风险评估和管理视为一个持续的过程。如果不这样做,就意味着将很快无法调整系统、服务和安全性来应对

...[详细]中证金力挺民企债券融资专项计划 完善民营企业债券融资支持机制

民企债券融资迎来重要支持方案。证监会11日晚称,交易所债券市场推出民营企业债券融资专项支持计划,以稳定和促进民营企业债券融资。中证金正是大名鼎鼎的国家队,成立于2011年10月,2015年市场大幅波动

...[详细]

民企债券融资迎来重要支持方案。证监会11日晚称,交易所债券市场推出民营企业债券融资专项支持计划,以稳定和促进民营企业债券融资。中证金正是大名鼎鼎的国家队,成立于2011年10月,2015年市场大幅波动

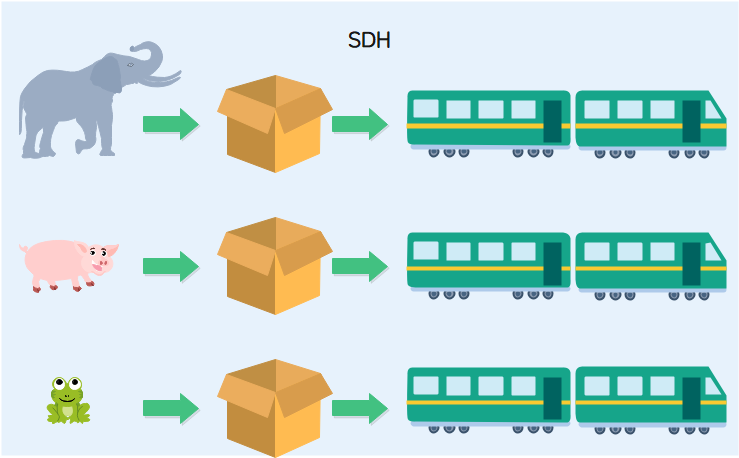

...[详细] 趣解承载:一文搞清PTN与IPRAN作者:中兴文档 2023-06-01 21:43:53网络 网络管理 老帮主SDH创派之初立下了规矩:货物想运输,必须是“块状结构”,必须是“标准”大小,而且按照货

...[详细]

趣解承载:一文搞清PTN与IPRAN作者:中兴文档 2023-06-01 21:43:53网络 网络管理 老帮主SDH创派之初立下了规矩:货物想运输,必须是“块状结构”,必须是“标准”大小,而且按照货

...[详细]